Para las personas que no pueden hablar, la innovación tecnológica que les ayuda a comunicarse ha sido escasa

David James "DJ" Savarese ganó una beca Iowa Arts Fellowship para cursar un máster en Bellas Artes en la Universidad de Iowa (EE UU), y en diciembre de 2022 asistió a una entrevista televisada con un canal de noticias local. Savarese es un poeta de 30 años con autismo, que utiliza métodos de comunicación alternativos, así que ideó una estrategia de comunicación para responder a las preguntas del presentador. Desde su infancia ha tenido que recurrir a este tipo de mecanismos.

Savarese fue entrevistado a distancia, desde el sofá de su salón en la ciudad de Iowa. "¿Qué le motiva a escribir poesía?", preguntó el presentador. Pude ver cómo Savarese apartaba brevemente la cabeza de la cámara, como para componer un pensamiento. Luego se inclinó hacia su portátil, un MacBook Pro que también es su instrumento de comunicación, y pulsó unas teclas para activar una voz sintetizada. "La poesía me ofrece una forma de responder menos y conversar más".

"En una época donde el miedo domina las ondas", prosiguió, "la poesía despierta de nuevo los sentidos y nos aleja de una experiencia basada en el significado, liberando las ideas para que se mezclen a través de las fronteras del cerebro y llevándonos más allá de las construcciones artificiales y clasificatorias del poder". Mientras tanto, se balanceaba y asentía al ritmo de sus frases, que ascendían y decaían como si de música se tratase.

Cambié mi atención para averiguar la configuración técnica de Savarese. No vi ningún cable ni dispositivo en el encuadre. ¿Utilizaba un chip cerebral para transmitir sus pensamientos de manera inalámbrica a una aplicación de tratamiento de textos de su ordenador?; ¿Es el futuro?

Además, hubo una razón para centrarme en ello. En aquel momento, estaba investigando la tecnología de comunicación aumentativa y alternativa (CAA) para mi hija, que tenía cinco años y tampoco se comunicaba de manera verbal. Me encontraba abrumada por las opciones disponibles: un puñado de aplicaciones para iPad que parecen (y funcionan) como si estuvieran codificadas en los años 90. Por tanto, me adentré en el mundo tan especulativo como emocionante de las interfaces cerebro-ordenador. ¿Podría un chip cerebral permitir a mi hija expresarse verbalmente con el mismo esfuerzo que me cuesta a mí abrir la boca y hablar? ¿Cómo sonaría al contarme su día en el colegio, cantar el "cumpleaños feliz" o al pronunciar "mamá"? Quería que el futuro estuviera aquí y ahora.

Ver a Savarese me reveló un pensamiento mágico. Detrás de la cortina, la mecánica de su comunicación era de baja tecnología, de hecho, algo extraña.

El proceso no encajaba en el molde de lo que consideraba que debía hacer la tecnología: eliminar el trabajo de una operación manual, y hacerlo más rápido y fácil. La cadena había invitado a Savarese al programa y un productor le había enviado las preguntas por correo con antelación. Para prepararse, Savarese había pasado unos 15 minutos tecleando sus respuestas en un archivo de Microsoft Word. Cuando llegó el momento de la entrevista en directo, el presentador recitó las preguntas, a las que Savarese respondió en su MacBook utilizando la función "Leer en voz alta" de Word para enuncias sus respuestas, ya preestablecidas. Los tipos de tecnología disponibles que podrían impulsar un dispositivo de ayuda a la comunicación (inteligencia artificial, procesamiento del lenguaje natural, predicción de palabras, bancos de voz, seguimiento de la mirada) no desempeñaron ningún papel en esta entrevista. Sin ninguna de las funciones que esperaba ver, Savarese tenía las herramientas que necesitaba para expresar sus pensamientos con plenitud.

Tras seis años cuidando a una niña discapacitada en un mundo incapacitado, he aprendido a mantener la mente abierta a todas las posibilidades. Aunque mi hija tiene una discapacidad intelectual y física -pues nació sin 130 genes y 10 millones de pares de bases de ADN-, es una niña sana, alegre y obstinada. Desde que llegó a nuestras vidas, me ha sorprendido una y otra vez que las cosas sencillas que harían su vida más fácil, como los cortes de las aceras, lápices de colores más gruesos, o simple amabilidad- no estén más extendidas en nuestra avanzada sociedad. Tenemos una serie de elementos tan sofisticados e ingeniosos como inimaginables. Por ejemplo, entornos calmantes de realidad virtual que pueden ser integrados en escáneres de resonancia magnética con temática de Frozen. Tiene sentido que, al principio, mientras veía a Savarese, supusiera que utilizaba un chip cerebral implantado para transmitir sus pensamientos a un documento de Word. Me parecía más plausible que revolucionario. Cuando me di cuenta de que no había ningún chip, solo unos correos electrónicos y un Word, una familiar sensación de decepción me devolvió a la Tierra con un ruido sordo.

"Todo avanza despacio porque tiene que ser compatible con el pasado. Esto significa que, si el pasado fue algo torpe, parte del presente también lo es", me contó Mark Surabian, consultor de CAA.

Surabian, de 61 años, lleva 35 años formando a administradores y logopedas de cientos de colegios. También ha enseñado a estudiantes de posgrado en casi todos los programas de formación de profesores de educación especial de Nueva York, incluidos los del Columbia Teachers College y la Universidad de Nueva York (EE UU). Además, está especializado en la personalización de aplicaciones de CAA para satisfacer las necesidades específicas de sus propios clientes y se ha convertido en el técnico indispensable que colabora con logopedas, profesores y neuropsicólogos para encontrar tanto el hardware como el software adecuados para los usuarios.

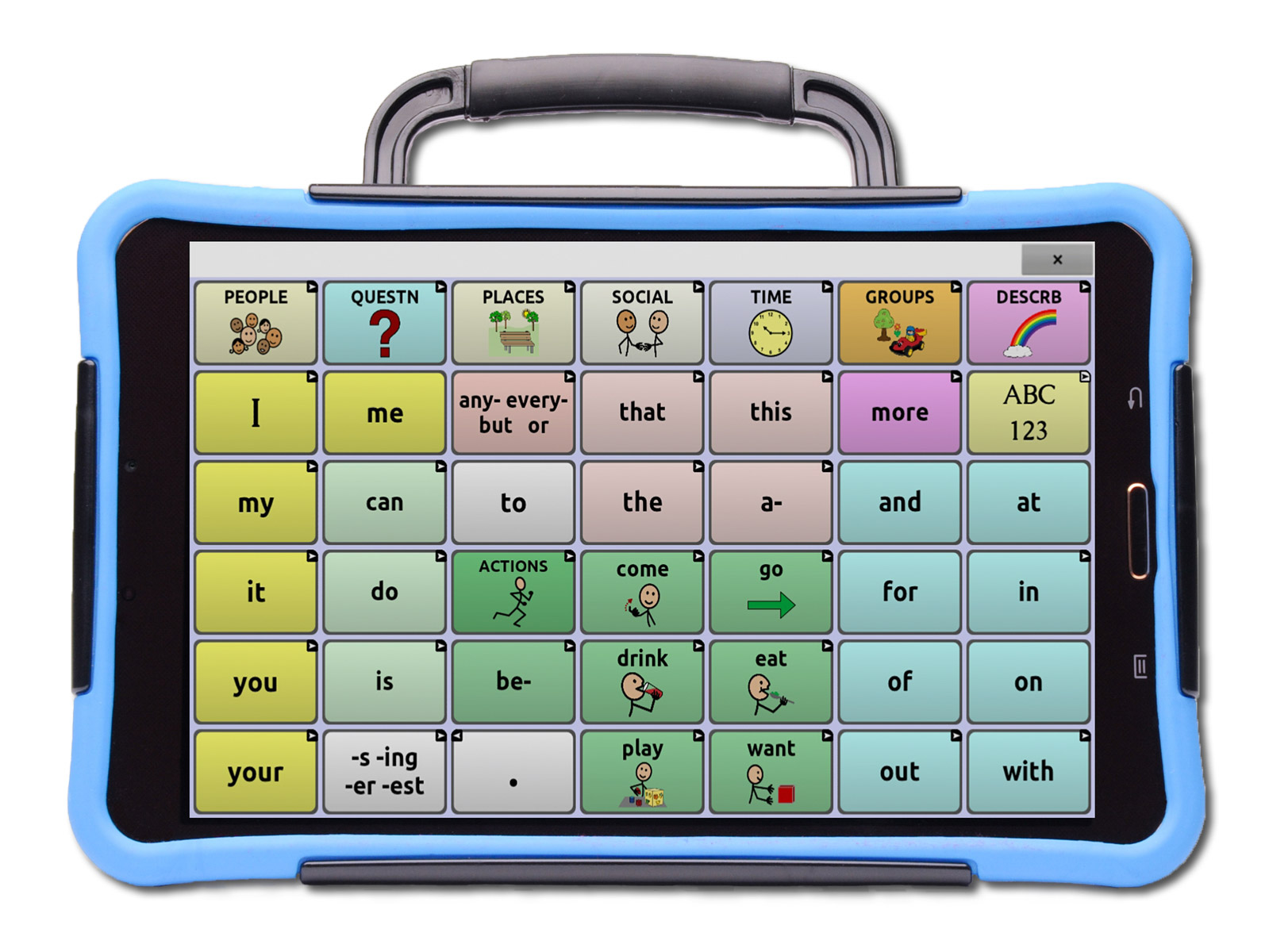

TouchChat, la pantalla por defecto del dispositivo de comunicación de PRC-Saltillo, por ejemplo, consta de 12 filas de ocho botones que muestran una mezcla de letras, iconos de objetos (manzana), iconos de categorías (comida) y elementos de navegación (flechas hacia atrás); y muchos en colores neón. Parte de lo exasperante de la interfaz es el trato similar que da a cada botón: todos tienen el mismo tamaño, 200 por 200 píxeles, y no hay una lógica obvia en la colocación de los botones, el tamaño del texto o las mayúsculas. Algunas palabras están extrañamente abreviadas ("DESCRB"), mientras que otras ("gracias") se reducen para ajustarse a la anchura de la caja. El gráfico de "guay" es un palo sonriente que levanta el pulgar, que además es redundante con "bien" (un pulgar hacia arriba), "sí" y "me gusta" (ambos sonrientes). ¿Qué pasa si el usuario quiere decir "bien" para describir el buen tiempo?

Los principios de jerarquía de la información y diseño de interfaces para dispositivos de CAA no están estandarizados, depende de Surabian definir el número y el tamaño de los botones de cada pantalla. Así como el tamaño de los iconos, el tamaño de la tipografía y si la posición de un botón debe cambiar o permanecer fija.

“Todo avanza despacio porque tiene que ser compatible con el pasado. Esto significa que, si el pasado fue algo torpe, parte del presente también lo es”.

Mark Surabian, consultor de CAA

Entonces, llamé a Surabian con la esperanza de que me cautivara. Cuando quedamos en un café del bajo Manhattan, me entusiasmó su maleta de ruedas y pensé que me enseñaría lo mejor de la CAA. Pero, una vez más, me decepcionó.

Ya que el último gran avance en tecnología de CAA se produjo hace 13 años, una eternidad cuando se trata de tiempo tecnológico. El 3 de abril de 2010, Steve Jobs presentó el iPad. Para la mayoría fue solo un factor de forma más conveniente, pero para las personas no verbales fue algo más: una revolución que cambió sus vidas al acceder a un dispositivo de comunicación atractivo, portátil y potente por solo unos cientos de dólares. Al igual que los smartphones, los iPads tenían pantallas táctiles integradas, pero con la ventaja de disponer de más espacio para mostrar en una sola pantalla docenas de botones basados en iconos. Por primera vez, los usuarios de CAA pudieron utilizar de otras formas el mismo dispositivo que usaban para comunicarse. También podían enviar mensajes de texto, utilizar FaceTime, navegar por internet, ver películas, grabar audios y compartir fotos.

"Los distritos escolares y los padres compraban un iPad, nos lo traían y nos decían: 'Haz que funcione'", escriben Heidi LoStracco y Renee Shevchenko, dos logopedas de Filadelfia que trabajan exclusivamente con niños no verbales. "Llegó un momento en el que todos los días alguien nos pedía aplicaciones de iPad para CAA. Les decíamos: 'Todavía no hay ninguna aplicación de CAA eficaz, pero, cuando la haya, seremos las primeras en contárselo'".

Una pieza de hardware, por muy impresionante que sea su diseño y su ingeniería, es tan valiosa como lo que una persona puede hacer con ella. Tras el lanzamiento del iPad, nunca llegó la avalancha de nuevas aplicaciones de CAA fáciles de usar que LoStracco, Shevchenko y sus clientes querían.

En la actualidad, existen media docena de aplicaciones, cada una de ellas con un precio de venta al público de entre 200 y 300 dólares (de 180 a 270 euros). Además, se basan en convenciones de hace 30 años, ya que piden a los usuarios que seleccionen entre menús de iconos toscamente dibujados para producir texto y voz sintetizada. Aparte de su elevado precio, la mayoría de las aplicaciones de CAA requieren la personalización de un especialista para ser útiles. Este podría ser el motivo de que el acceso siga siendo un problema; LoStracco y Shevchenko afirman que solo el 10% de las personas no verbales de EE UU utilizan esta tecnología. AAC Counts, un proyecto de CommunicationFIRST -una organización nacional de defensa de las personas con discapacidades del habla- destacó la necesidad de disponer de mejores datos sobre los usuarios de CAA.

No hay muchas más opciones, aunque las posibilidades dependen de las capacidades del usuario. Por ejemplo, las personas alfabetizadas que no hablan y tienen control motriz de brazos, manos y dedos pueden utilizar programas de conversión de texto a voz disponibles en un smartphone, una tablet o un ordenador de sobremesa o portátil. Aquellos cuyo control motor fino es limitado también pueden utilizar estas aplicaciones con la ayuda de un puntero láser controlado por los ojos, un puntero físico sujeto a la cabeza u otra persona que les ayude a manejar una pantalla táctil, un ratón o un teclado. Las opciones se reducen para los usuarios poco alfabetizados y con discapacidad cognitiva, que se comunican con conjuntos de imágenes. En el caso de mi hija, me intrigó una opción de "tecnología media": el Logan ProxTalker, una consola de 13 pulgadas con altavoz incorporado y un kit de etiquetas sonoras con RFID. Una de las cinco estaciones de la consola reconoce las etiquetas, cada una de las cuales está preprogramada para emitir un icono único. Pero entonces vi su precio: 3.000 dólares (unos 2.700 euros) por 140 etiquetas. Para contextualizar, los Institutos Nacionales de Salud calculan que un niño medio de cinco años puede reconocer más de 10.000 palabras.

Es difícil pensar que los consumidores sin discapacidad vayan a aceptar el mismo ritmo lento de mejora progresiva para una función humana tan esencial como es el habla.

Sueño con las interfaces cerebro-ordenador anunciadas como la próxima frontera: implantes que enviarían señales del sistema nervioso central a un ordenador, sin necesidad de voz ni activación muscular. Pero el concepto de interfaz cerebro-ordenador está plagado de importantes y legítimas cuestiones éticas. En parte por esa razón, las ICB están demasiado lejos como para tomárselas en serio ahora mismo. Mientras tanto, en el mediocre presente, es difícil pensar que se espere que los consumidores no discapacitados acepten el mismo ritmo lento de mejora incremental para una función humana tan esencial como es el habla.

A finales de la década de los 2000, las empresas de CAA se prepararon para un cambio masivo. Cuando hablé con Sarah Wilds, directora de Operaciones de PRC-Saltillo, describió el ambiente que se respiraba en la reunión anual de la empresa en 2008, cuando empezó a trabajar allí.

"Todos los logopedas estábamos en esta sala", contó Wilds, que completa: "Alguien dijo: 'Hay una cosa llamada iPod Touch'. Y todos dijeron: 'Tenemos ordenadores. ¿Por qué querría alguien una pantalla pequeña?'".

"Al año siguiente, la gente decía: 'Dios mío, lo están haciendo, ¿y si esas pantallas se hacen más grandes? Y al año siguiente llegó el iPad. A todos nos horrorizaba que cualquiera pudiera ir a la tienda, elegir uno y ponerle una aplicación".

Estaban horrorizados porque presuponían que la nueva tecnología rebajaría el precio del tipo de herramientas que fabricaban y vendían. Los desarrolladores de AAC, en marcado contraste con una empresa como Apple, no estaban preparados para vender su software a las masas en 2010. El puñado de empresas de CAA de EE UU -PRC, Saltillo y Dynavox eran las más grandes- llevaban 30 años dirigiendo modestas operaciones de fabricación y venta de programas ya cargados en su hardware propietario. Aunque PRC presentó su primer dispositivo en 1969. Sus fundadores, lingüistas y logopedas, eran optimistas sobre el potencial de la tecnología; también eran realistas y reconocían que la comunicación asistida nunca sería un negocio en auge. El mercado de la comunicación asistida era, y sigue siendo, relativamente pequeño. Según el Instituto Nacional de la Sordera y Otros Trastornos de la Comunicación (NIDCD, por sus siglas en inglés), entre el 5% y el 10% de los residentes de EE UU tienen una deficiencia comunicativa, y solo unos pocos necesitan dispositivos de asistencia.

Cuando le pregunté a Wilds cuántas personas utilizan los productos de PRC-Saltillo, me contestó que la empresa es privada y no hace públicos sus balances. Sobre el panorama general, explicó que la demanda de aplicaciones desarrolladas por empresas de CAA suele ser 10 veces mayor que la de sus productos de hardware. Ese "dispositivo de hardware especial para la comunicación" probablemente sea un iPad.

En otoño de 2022, cuando empecé a buscar un dispositivo para mi hija, su logopeda me remitió a AbleNet, un proveedor externo de tecnología de apoyo. Los distritos escolares públicos de EE UU también pueden adquirir dispositivos de CAA en nombre de los alumnos que los necesiten, pero en aquel momento mi hija no cumplía los requisitos porque la prestación no figuraba aún en su programa educativo individualizado. Un representante de AbleNet me envió un presupuesto para un Quick Talker Freestyle, un "dispositivo de habla basado en iPad" por el que facturarían a nuestro seguro médico 4.190 dólares (unos 3.765 euros). La "contribución familiar", me aseguró el representante, sería sólo de 2.245 dólares (2.017 euros).

Por ese precio, seguro que el Quick Talker Freestyle ofrecería algo más avanzado que una app que podía descargar en el iPad reacondicionado que ya había comprado a Apple por 279 dólares (unos 250 euros). Un iPad nuevo de novena generación se vende por 329 dólares (296 euros). Cuando pedí más detalles, me pasaron con un supervisor de asistencia de prestaciones, que me sugirió que me apuntara al plan de pago de la empresa. Más tarde me enteré de que, para cumplir los requisitos de Medicaid y de los seguros médicos, los proveedores de tecnología de CAA de terceros suelen eliminar las apps de Apple de los iPads que distribuyen, esto los hace menos útiles pero a un precio 10 o 20 veces superior que el mismo hardware que cualquier otra persona puede comprar en cualquier tienda.

Cuando me puse en contacto con AbleNet, Joe Volp, vicepresidente de marketing y relaciones con los clientes, me detalló las ventajas de servicio al cliente incluidas en el precio, como un periodo de prueba del dispositivo, una garantía ilimitada de cinco años y una rápida respuesta en caso de reparación. Son buenas opciones, pero ni de lejos justifican el sobrecoste.

Le conté mi experiencia a Wilds, que se mostró comprensiva. "Es muy difícil ser una empresa que solo vende apps en el mundo de la tecnología de apoyo", explicó. Las empresas de CAA necesitan encarecer el hardware para financiar el desarrollo de sus aplicaciones.

La mayoría de las empresas de CAA fueron creadas por expertos en desarrollo tecnológico, no en distribución. Durante las tres últimas décadas, han desarrollado sus productos como dispositivos médicos aprobados por la FDA para aumentar las posibilidades de que Medicaid, las aseguradoras sanitarias privadas y los distritos escolares paguen por ellos. Para compensar el reducido tamaño del mercado, los desarrolladores apostaron por un enrevesado modelo de negocio que exigía que un médico o un logopeda autorizado "prescribiera" el dispositivo, con un precio estratégico (y astronómico) para subvencionar el coste de su desarrollo.

Antes de 2010, las empresas que creaban su propio hardware y software de CAA desde cero podían salirse con la suya al mantener la opacidad sobre su estrategia de precios. Pero, cuando Apple fabricó en serie una versión mejorada del hardware que habían desarrollado internamente, el humo y los espejos desaparecieron. Así dejaron al descubierto un sistema que se parece mucho a la manipulación de precios.

Sería demasiado fácil tachar a las empresas de CAA de villanas, pero, teniendo en cuenta que operan en el mismo mercado que los productos tecnológicos más populares del mundo, es un pequeño milagro que existan. El problema de encarecer los precios de los productos para cubrir el coste de su desarrollo no es un caso aislado. Con demasiada frecuencia, a falta de una entidad pública o privada que financie de forma proactiva una tecnología altamente especializada con el potencial de cambiar o incluso salvar un pequeño número de vidas, la norma es la especulación con los precios.

Quizá sean mis expectativas las que fallan. Puede que sea ingenua al esperar que una tecnología de CAA asequible y revolucionaria surja del mismo contexto que sustenta a miles de millones de personas que venden maquillaje y publican selfies. Tal vez sea necesario un ámbito totalmente distinto, con sus propios incentivos, para desarrollar productos tecnológicos dirigidos a un pequeño público objetivo que podría beneficiarse de ellos.

En marzo de 2023, Savarese aceptó reunirse conmigo para mantener una conversación online y en directo. Por nuestros intercambios de correos, intuí que se sentía más cómodo comunicándose de forma asíncrona, por escrito. Le envié una lista de preguntas por adelantado. Quería conocer su opinión sobre algunos temas difíciles, y no quería que los inconvenientes del directo le limitaran.

Unos minutos antes de nuestra reunión, Savarese me envió un documento de Word de ocho páginas donde había copiado mis preguntas y añadido sus respuestas, que eran una mezcla de citas de sus escritos anteriores y material nuevo que había tecleado.

“Imaginar que la tecnología por sí sola puede liberarnos es un poco miope y, en cierto modo, incapacitante”.

David James "DJ" Savarese

Además, Savarese añadió a mi lista una pregunta sobre los dispositivos de CAA: "¿Han mejorado?". A lo que él respondió: "Claro: son más ligeros, menos caros, han consolidado todas mis necesidades de comunicación y trabajo basadas en la palabra gracias a un dispositivo más o menos pequeño (portátil o iPad). La sutileza de las voces está mejorando, aunque he optado por utilizar la misma voz a lo largo de los años y no puedo acercarme a cómo debería sonar un poema que he escrito sin entrenar y grabar a un poeta de confianza que hable y los lea en voz alta."

Dada la existencia del documento Word-que, en esencia, era la transcripción de una entrevista que estaba a punto de realizar, ¿cuál sería el propósito de nuestra conversación en directo? Sugerí a Savarese que podía leer el documento en voz alta, al menos, las palabras que yo misma había escrito. Pero me pareció invasivo utilizar mi voz para leer las respuestas de Savarese; es comprensible que se sienta frustrado por la tendencia de los demás a hablar por él.

En su lugar, le pedí que pegara sus respuestas preescritas en la ventana de chat o que utilizara la función “Leer en voz alta” para pronunciarlas. A lo largo de la entrevista, parafraseé sus respuestas y le hice preguntas de seguimiento para asegurarme de que le estaba interpretando correctamente. Seguí su ejemplo, alternando entre los distintos modos de comunicación.

De este modo, Savarese habló de su historia personal de comunicación aumentativa y alternativa. Cuando tenía seis años, aprendió lenguaje de signos (ASL, siglas del lenguaje de signos estadounidense) con sus padres no discapacitados. En la escuela primaria, le equiparon con un rotulador de 17 dólares (15 euros) de Staples para enseñarle a leer y escribir. En cuarto curso, Savarese empezó a escribir sus pensamientos en un ordenador Gemini, una versión mejorada de 12.000 dólares (10.778 euros) de un portátil de Apple a finales de la década de 1990.

El Gemini necesitaba un enchufe y un profesor que le ayudara a moverlo. De acuerdo con los requisitos de Medicaid, que obligan a los fabricantes a eliminar funciones que podrían tentar a los padres a utilizar ellos mismos un dispositivo, no tenía procesador de textos ni acceso a internet. Savarese se adaptó y siguió utilizando su rotulador para rellenar exámenes, escribir poemas y cuentos. Para escribir más rápido, montó tiras de papel preimpresas con palabras y frases de uso común, sacadas de un banco de palabras hecho por su madre.

"En aquel momento, para mí era todo un acontecimiento tener lo que parecía mi propio ordenador", rememoró Savarese. "Así que ese estatus compensaba, en cierto modo, los inconvenientes".

Savarese recuerda sus primeros años de CAA con sorprendente nostalgia: "Estas tecnologías eran más multisensoriales, más comunitarias y, en cierto sentido, más democráticas. Mediante las imágenes, el lenguaje de signos y las palabras tangibles, mis padres, profesores, amigos y yo éramos todos aprendices, y todos profesores". Cuando estaba en 10º curso, el software de conversión de texto a voz ya era lo bastante omnipresente como para venir preinstalado en un portátil, un dispositivo ligero que permitía a Savarese comunicarse tanto en silencio como en voz alta.

"Imaginar que la tecnología por sí sola puede liberarnos es un poco miope y, en cierto modo, incapacitante", escribió. Pero tiene una lista de mejoras, por ejemplo, una voz más audible integrada en portátiles, tablets y smartphones para que los demás puedan oírle mejor. Le gustaría disponer de un software de presentación de diapositivas con opciones personalizables de lectura de guiones, para que los usuarios puedan sincronizar su voz en off con el cambio de diapositivas. También cree que a la predicción de palabras le queda mucho camino por recorrer para ser realmente útil y menos prescriptiva.

Sin embargo, la actitud de Savarese hacia la tecnología de CAA sigue siendo realista, incluso generosa. "Vivo en una sociedad centrada en el habla, debo tener una forma de comunicación, basada en el habla, para interactuar con la mayoría", me explicó. "Puedo ganarme la vida como escritor, cineasta, presentador, colaborador y activista (inter)nacional. Mis dispositivos de CAA me han ofrecido la voz pública que necesitaba para existir como miembro esencial de estas comunidades".

La recompensa para Savarese, y su público, es grande: "Quizá me ha ido mejor con la edad. A la gente le interesa oír lo que tengo que decir".

Julie Kim es escritora y reside en Nueva York.