Cada vez más empresas afirman ser capaces de simular la naturaleza humana y anticipar sus actos, pero el concepto de la 'analítica de personas' no es nuevo, sino que descansa sobre un historial de intentos fallidos que han causado estragos sociales, como describe el último libro de Jill Lepore, 'If Then'

Es muy probable que los trabajadores del Banco de América y los del Ejército de EE. UU. hayan utilizado la tecnología de Humanyze alguna vez. La empresa surgió de una investigación del interdisciplinario Media Lab del MIT (EE. UU.) y describe sus productos como "análisis científicos para impulsar la adaptabilidad".

Si el concepto le suena vago y poco preciso, probablemente sea a propósito. Entre los productos que Humanyze vende a las empresas figuran dispositivos para espiar a los empleados, como tarjetas de identificación con etiquetas RFID, sensores de comunicación de campo cercano y micrófonos incorporados que rastrean con gran detalle el tono y el volumen (aunque no las palabras reales) de las conversaciones de las personas a lo largo del día. Humanyze ha registrado su "Valoración de salud organizacional", que se calcula sobre la base de los datos de los empleados recogidos de sus acreditaciones, y la empresa promete que es "una fórmula comprobada para acelerar el cambio e impulsar la mejora".

Algo similar sufren los trabajadores de empresas de servicios financieros, retail o de atención médica que utilizan software desarrollado por Receptiviti. La misión de esta empresa con sede en Toronto (Canadá) es "ayudar a las máquinas a comprender a las personas" analizando correos electrónicos y mensajes de Slack en busca de indicios lingüísticos de infelicidad.

En una reciente entrevista con The Wall Street Journal, el CEO de Receptiviti, Jonathan Kreindler, afirmó: "Nos preocupa ser percibidos como un Gran Hermano". Prefiere referirse a la vigilancia de los empleados como un "mindfulness corporativo". (Orwell también hubiera tenido algo que decir sobre ese eufemismo).

Las iniciativas de lo que sus creadores denominan como "análisis de personas" generalmente se justifican por la mejora de la eficiencia o la atención al cliente. En los últimos meses, algunos gobiernos y expertos en salud pública han defendido las aplicaciones de rastreo y seguimiento de personas como un medio para detener la propagación del coronavirus (COVID-19).

Pero al adoptar estas tecnologías, las empresas y los gobiernos tienden a obviar algunas preguntas cruciales: ¿Quién debería saber qué sobre nosotros? ¿Es fidedigno lo que saben? ¿Qué deberían poder hacer con esa información? ¿Es realmente posible idear una "fórmula comprobada" para valorar el comportamiento humano?

Estas preguntas tienen su historia, pero parece que los tecnólogos actuales no la conocen. Prefieren centrarse en las novedosas e ingeniosas formas en las que sus inventos pueden mejorar la experiencia humana (o el resultado corporativo) en vez de en cómo la gente de épocas anteriores intentó hacer lo mismo sin éxito. Cada nuevo algoritmo o aplicación es, en su opinión, una reprimenda implícita del pasado.

Pero ese pasado puede ofrecer una guía y una dosis de humildad muy necesarias. A pesar de tener ordenadores más rápidos y algoritmos más sofisticados, la "analítica de personas" de hoy en día está impulsada por una vieja idea reduccionista: la opinión de que la naturaleza humana en todas sus complejidades puede reducirse a una fórmula. Sabemos lo suficiente sobre el comportamiento humano como para explotar las debilidades de los demás, pero no tanto como cambiarlo significativamente, excepto quizás en los márgenes.

El nuevo libro If Then de la historiadora de la Universidad de Harvard (EE. UU.) y redactora del New Yorker, Jill Lepore, cuenta la historia de una olvidada empresa tecnológica que existía a mediados del siglo XX llamada Simulmatics Corporation. Fundada por un variado grupo de científicos y publicistas en 1959, fue, según Lepore, la "Cambridge Analytica de la Guerra Fría de Estados Unidos".

Una descripción más precisa podría ser que se trataba de un esfuerzo de los demócratas estadounidenses para competir con la adopción de las técnicas de propaganda del Partido Republicano de EE. UU. A mediados del siglo, los republicanos promocionaban a sus políticos como si fueran papel higiénico o café. Simulmatics (que tuvo que pagar por horas el uso de los ordenadores de IBM para realizar sus cálculos) prometió ser capaz predecir el resultado de las elecciones casi en tiempo real. Aunque ahora esa práctica es tan común que resulta rutinaria, en aquel entonces era innovadora, si no imposible.

El nombre de la empresa, un acrónimo de "simulación" y "automático", era un ejemplo de la ambición de sus creadores: "automatizar la simulación del comportamiento humano". Su herramienta principal era People Machine, algo que Lepore describe como "un programa informático diseñado para predecir y manipular el comportamiento humano, todo tipo de conducta humana, desde comprar un lavavajillas hasta contrarrestar una insurgencia y votar". Funcionó desarrollando categorías de personas (como la madre blanca católica de clase trabajadora o la madre republicana de un barrio residencial) y simulando su posible toma de decisiones. (La publicidad dirigida y las campañas políticas actuales utilizan técnicas muy similares).

Los principales representantes de la compañía provenían de una variedad de lugares. El publicista Ed Greenfield fue uno de los primeros en prever cómo la nueva tecnología de la televisión revolucionaría la política y en asegurar que los primeros ordenadores ejercerían una fuerza igual de disruptiva sobre la democracia. El ambicioso científico social Ithiel de Sola Pool, ansioso por trabajar con el Gobierno estadounidense para descubrir los secretos del comportamiento humano, finalmente se convirtió en uno de los primeros teóricos proféticos de las redes sociales.

Más que cualquier otra persona de Simulmatics, Pool encarnaba tanto el fervor idealista como la negligencia sobre la ruptura de normas que caracteriza a los innovadores tecnológicos actuales. Hijo de padres radicales que había coqueteado con en el socialismo cuando era joven, pasó el resto de su vida demostrando que era un patriota comprometido con la Guerra Fría. Una vez llegó a describir su trabajo en Simulmatics como "una especie de apuesta política del Proyecto Manhattan".

Uno de los primeros grandes clientes de la compañía fue la campaña presidencial de John F. Kennedy en 1960. Cuando Kennedy ganó, la compañía reclamó su reconocimiento. Pero también empezó a enfrentarse a la preocupación de que la máquina que había construido pudiera utilizarse para propósitos nefastos. Como escribió un científico en una reseña sobre la empresa en la revista Harper's, publicada poco después de las elecciones: "No se pueden simular las consecuencias de una simulación". La gente temía que empresas como Simulmatics pudieran tener una influencia corruptora en el proceso democrático. Esto, recordemos, pasó casi medio siglo antes de la creación de Facebook.

Sin embargo, una parte del Gobierno de EE. UU. estaba entusiasmada con las capacidades predictivas de la empresa: el Departamento de Defensa. Como recuerda Lepore a los lectores, las estrechas alianzas entre los tecnólogos y el Pentágono se consideraban esfuerzos patrióticos y necesarios para detener la marea del comunismo durante la Guerra Fría.

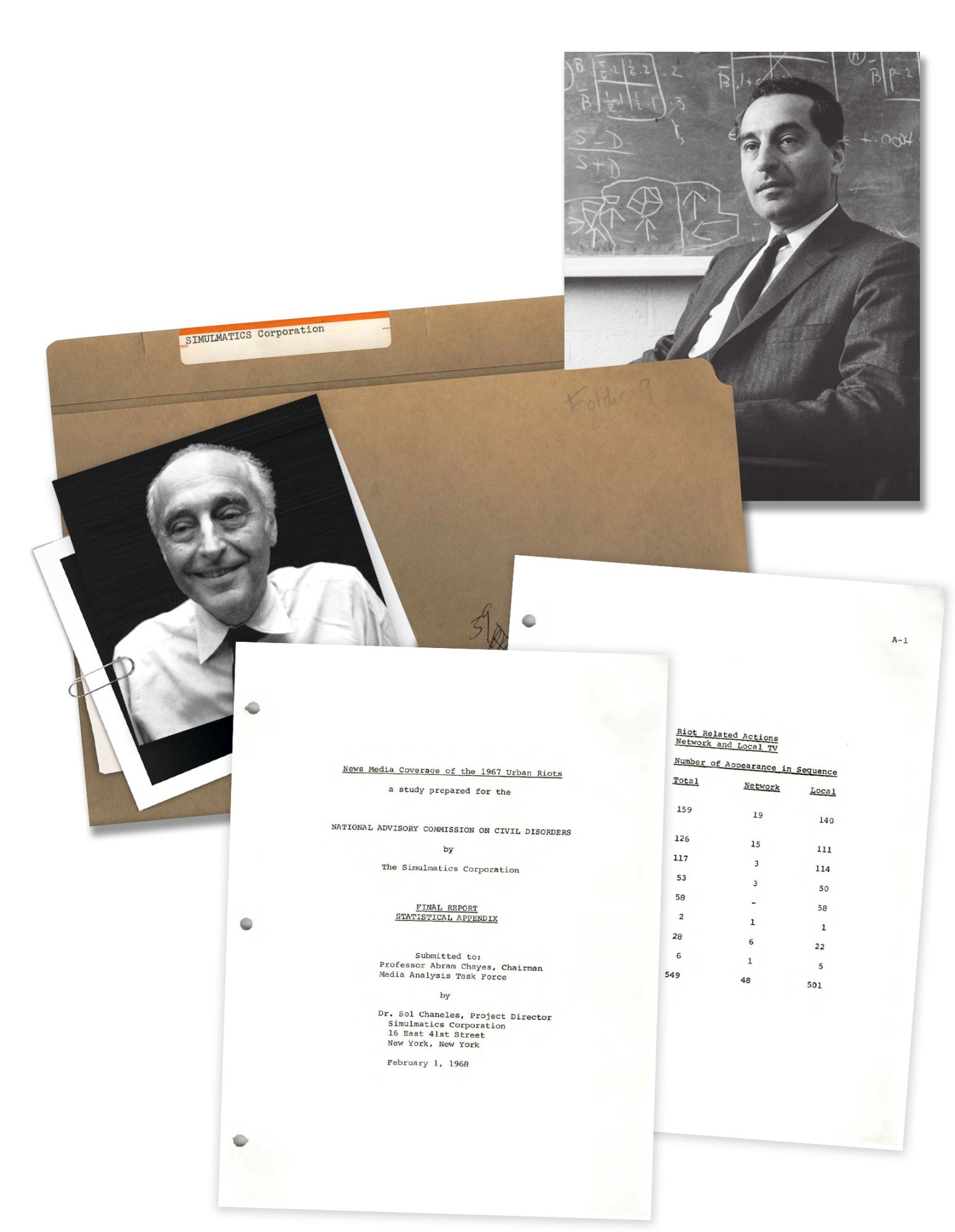

Foto: El cofundador de Simulatics, Ithiel de Sola Pool (izquierda), describió una vez su trabajo como una especie de "apuesta política del Proyecto Manhattan ". La Comisión Kerner, convocada por el entonces presidente de EE. UU., Lyndon Johnson, en 1967 para estudiar los disturbios raciales que habían estallado en todo el país, pagó a la División de Estudios Urbanos de Simulmatics para que diseñara una fórmula de predicción de disturbios.

En 1966, Pool aceptó el contrato para supervisar el proyecto de ciencia del comportamiento a gran escala para el Departamento de Defensa de EE. UU. en Saigón (Vietnam). La idea le entusiasmaba y pensó: "¡Vietnam es el mayor laboratorio de ciencias sociales que hemos tenido jamás!".

Al igual que el secretario de Defensa estadounidense Robert McNamara (a quien Barry Goldwater una vez se refirió como "una máquina de IBM con piernas" y quien organizó la investigación), Pool creía que en los "corazones y mentes" de los vietnamitas la guerra acabaría en victoria, y que para ganar se necesitaba un modelado de las ciencias del comportamiento y simulación. Como escribe Lepore, "Pool argumentó que mientras los estadistas del pasado habían consultado la filosofía, la literatura e historia, los de la Guerra Fría estaban obligados a consultar las ciencias del comportamiento".

Sus esfuerzos de contrainsurgencia por ordenador fueron un fracaso desastroso, en gran parte porque los datos de Simulmatics sobre los vietnamitas eran parciales y sus simulaciones se basaban más en ilusiones que en realidades sobre el terreno. Pero esto no impidió que el Gobierno federal estadounidense acudiera a Pool y Simulmatics para comprender y predecir las protestas civiles en EE. UU.

La Comisión Kerner, nombrada por el presidente Lyndon Johnson en 1967 para analizar los disturbios raciales que habían estallado en todo el país, pagó a la División de Estudios Urbanos de Simulmatics para que diseñara una fórmula para predecir los motines y alertar a las autoridades sobre las protestas antes de que se convirtieran en revueltas. Igual que las predicciones para Vietnam, estas también resultaron cuestionables. En la década de 1970, Simulmatics se declaró en quiebra y "la simulación automatizada por ordenador del comportamiento humano acabó siendo desprestigiada", según Lepore.

"La recogida y el uso de datos sobre el comportamiento humano con fines de lucro, no regulados por ningún organismo gubernamental, ha causado estragos en las sociedades humanas".

Simulmatics "acecha detrás de la pantalla de cada dispositivo" que usamos, argumenta Lepore, y afirma que sus creadores, los "abuelos blancos muertos hace mucho tiempo de Mark Zuckerberg y Sergey Brin y Jeff Bezos y Peter Thiel y Marc Andreessen y Elon Musk", son un "eslabón perdido" en la historia de la tecnología. Pero esto sería una sobrevaloración. El sueño de clasificar, categorizar y analizar a las personas ha sido una constante a lo largo de la historia. El esfuerzo de Simulmatics fue simplemente uno de tantos, y no tan revolucionario.

Bastante más importantes (y dañinos) históricamente fueron los proyectos del siglo XIX para clasificar a los criminales, o las campañas de principios del siglo XX para predecir el comportamiento basado en las categorías pseudocientíficas de raza y etnia durante el apogeo del movimiento eugenésico. Para conseguir el éxito, todos estos proyectos también dependían de la recogida y sistematización de datos y de las alianzas con los gobiernos locales y estatales, pero además, generaban mucho entusiasmo de una gran parte de la sociedad, algo que Simulmatics nunca tuvo.

Lo que sí es cierto es que la combinación de idealismo y arrogancia de Simulmatics se parece a la de muchas empresas contemporáneas de Silicon Valley (EE. UU.). Igual que ellas, se veía a sí misma como la vanguardia de una nueva Ilustración, liderada por las personas más adecuadas para resolver los problemas de la sociedad, incluso a pesar de que no eran capaces de comprender la complejidad y la diversidad de esa sociedad.

Lepore escribe: "Sería más fácil, más reconfortante, menos inquietante, si los científicos de Simulmatics fueran villanos. Pero no lo eran. Eran liberales blancos de mediados del siglo pasado, en una era en la que no se esperaba que los liberales blancos entendieran a las personas que no eran blancas o liberales". Mientras que Simulmatics Corporation creía que la misma fórmula podía aplicarse a las poblaciones tan distintas como los votantes estadounidenses y los aldeanos vietnamitas, las tecnologías predictivas actuales a menudo hacen promesas igual de grandiosas. Pero la realidad es que, impulsadas por la recogida y análisis de datos mucho más sofisticados, aún no tienen en cuenta la gran variedad y la riqueza de la complejidad humana y sus diferencias.

Así que, aunque Simulmatics no inventó el futuro, tal y como afirma el subtítulo del libro de Lepore, sus intentos de categorizar y pronosticar el comportamiento humano plantearon dudas éticas sobre los datos que siguen vigentes a día de hoy. Lepore describe las audiencias del Congreso de EE. UU. sobre la privacidad de los datos en 1966, cuando un científico de RAND destacó al Congreso las preguntas que deberían hacerse: "¿Qué son los datos? ¿A quién pertenecen los datos? ¿Qué obligación tiene el recopilador, el titular o el analista de datos sobre el sujeto de los datos? ¿Se deberían compartir los datos? ¿Se deberían vender?"

Lepore lamenta el fracaso de la era anterior para abordar estas cuestiones: "Si, en aquel entonces, en la década de 1960, las cosas hubieran sido diferentes, este futuro se hubiese podido evitar. En aquella época mucha gente ya creía que una máquina para analizar a personas era total y absolutamente amoral". Pero también resulta curiosamente reconfortante saber que, incluso cuando nuestras tecnologías estaban en sus etapas rudimentarias, la gente ya estaba pensando en las posibles consecuencias de su uso.

Según las palabras de Lepore, Simulmatics se vio obstaculizada por las limitaciones tecnológicas de la década de 1960: "Los datos eran escasos. Los modelos eran débiles. Los ordenadores eran lentos. La máquina falló y los hombres que la construyeron no pudieron repararla". Pero, aunque las máquinas actuales son "más bonitas, más rápidas y aparentemente imparables", no son fundamentalmente diferentes de las de Simulmatics. Ambas se basan en la creencia de que las leyes matemáticas sobre la naturaleza humana son reales, al igual que las leyes de la física. Se trata de una creencia falsa. Lepore añade:

El estudio del comportamiento humano no es como que el estudio de la propagación de virus, de la densidad de las nubes y del movimiento de las estrellas. El comportamiento humano no sigue leyes como la de la gravedad, y creer que sí lo hace es prestar juramento a una nueva religión. La predestinación puede ser un evangelio peligroso. La recogida y el uso de datos sobre el comportamiento humano con fines de lucro, no regulados por ningún organismo gubernamental, ha causado estragos en las sociedades humanas, especialmente en las esferas en las que participó Simulmatics: política, publicidad, periodismo, contrainsurgencia y relaciones raciales.

Aunque Simulmatics fracasó porque se adelantó a su tiempo, sus homólogas actuales son más poderosas y más rentables. Pero recordar su historia puede ayudar a aclarar las deficiencias de una sociedad construida sobre las creencias reduccionistas en relación al poder de los datos, e iluminar el camino hacia un futuro humano digno y vibrante.