Un estudiante universitario ha utilizado GPT-3, la IA de lenguaje más avanzada, para generar publicaciones sobre autoayuda y productividad que en poco tiempo se han hecho virales. Casi ningún internauta se dio cuenta de que no habían sido escritas por un humano, lo que muestra el potencial del sistema para desinformar

A comienzos de la semana pasada, Liam Porr solo había oído hablar de GPT-3. Al finalizar la misma, este estudiante universitario utilizó este modelo de inteligencia artificial (IA) para crear un blog completamente falso con un nombre de autor inventado.

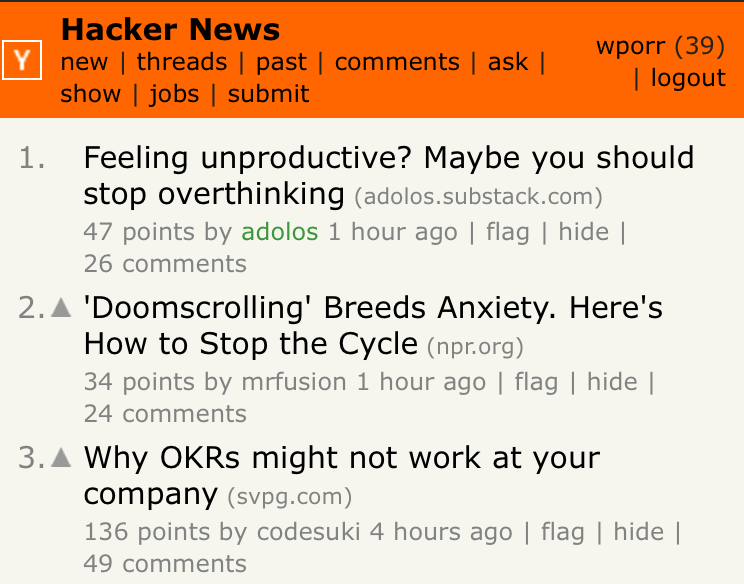

Lo ideó como un experimento divertido. Pero después, una de sus publicaciones alcanzó el puesto número uno en Hacker News. Pocas personas percibieron que su blog estaba generado completamente por IA y algunos incluso se suscribieron.

Aunque muchos han especulado sobre cómo GPT-3, la herramienta de inteligencia artificial generadora de texto más potente hasta la fecha, podría afectar la producción de contenido, es uno de los pocos casos conocidos que ilustra su potencial. Según Porr, que estudia ciencias de la computación en la Universidad de California en Berkeley (EE. UU.), esto fue lo más destacable de la experiencia: "Fue muy fácil en realidad, y eso es lo más alarmante".

GPT-3 es el último y mayor modelo de IA de lenguaje. OpenAI, un laboratorio de investigación con sede en San Francisco (EE. UU.), lo comenzó a usar a mediados de julio. En febrero del año pasado, OpenAI acaparó titulares con la versión anterior del algoritmo, GPT-2, anunciando que no lo publicaría por temor a que fuera mal usado. La decisión provocó de inmediato una reacción negativa, ya que los investigadores acusaron al laboratorio de haber lanzado un truco publicitario. En noviembre, el laboratorio cambió de opinión y publicó el modelo, afirmando que no había detectado "ninguna evidencia sólida de su mal uso hasta el momento".

El laboratorio adoptó un enfoque diferente con GPT-3: ni lo ocultó ni concedió acceso público. En lugar de esas opciones, el algoritmo seleccionaba a los investigadores que solicitaban una versión beta privada con el objetivo de que lo comentaran y comercializar la tecnología para finales de año.

Porr envió su solicitud. Completó un formulario con un simple cuestionario sobre el uso previsto. No esperó demasiado. Tras comunicarse con algunos miembros de la comunidad de IA de Berkeley, rápidamente encontró a un estudiante de doctorado que ya tenía acceso. Cuando aceptó colaborar, Porr escribió un pequeño script [una parte de código] para que lo ejecutara. Le dio a GPT-3 el título y la introducción para una publicación de blog e hizo que la IA creara varias versiones finales. La primera publicación de Porr (la que apareció en Hacker News) y todas las posteriores fueron copiadas y pegadas de los resultados con poca o ninguna edición.

"Pasaron quizás un par de horas desde el momento en el que se me ocurrió esa idea y me puse en contacto con el estudiante de doctorado hasta que realmente creé el blog y la primera publicación se volvió viral", asegura.

Foto: La falsa publicación de blog de Porr, escrita bajo el autor inventado "adolos", alcanzó el número 1 en Hacker News. Porr explica que usó tres cuentas separadas para enviar y votar sus publicaciones en Hacker News en un intento de llevarlas a los puestos más altos. El administrador del portal asegura que esta estrategia no funciona, pero sus titulares clickbait sí. 1. "¿Se siente improductivo? Quizá debería de dejar de pensar demasiado". 2. "El doomscrolling [navegar por internet siguiendo el hilo de las malas noticias] genera ansiedad. Aquí se explica cómo detener el ciclo". 3. "Por qué los OKR [Objetivos y Resultados Clave por sus siglas en inglés] podrían funcionar en tu compañía". Captura de pantalla /Créditos: Liam Porr

El truco para generar contenido sin la necesidad de editarlo demasiado consistía en comprender los puntos fuertes y las debilidades de GPT-3. "Es bastante bueno para crear un lenguaje bonito, pero no es muy lógico ni racional", explica Porr. Así que eligió una popular categoría de blogs que no requiere una lógica rigurosa: la productividad y la autoayuda.

A partir de ahí, escribió sus titulares siguiendo una fórmula simple: buscó en Medium y Hacker News para ver qué tenía éxito en esas categorías y creó algo relativamente similar. "¿Se siente improductivo? Quizá debería dejar de pensar demasiado", escribió como titular. "La audacia y la creatividad triunfan sobre la inteligencia", afirmaba otro. En algunos casos, los titulares no funcionaron. Pero manteniendo los temas acertados, el proceso fue fácil.

Después de dos semanas de publicaciones casi diarias, terminó el proyecto con un mensaje final, críptico y escrito por él mismo. Titulado "Lo que haría yo con GPT-3 si no tuviera ética", describía su proceso como hipotético. El mismo día, publicó una confesión directa en su blog real.

Foto: Las pocas personas que sospecharon del falso blog de Porr fueron criticadas por otros miembros de la comunidad. Captura de pantalla / Créditos: Liam Porr

Porr admite que quería demostrar que GPT-3 podía hacerse pasar por un escritor humano. De hecho, a pesar del patrón algo extraño de escritura del algoritmo y de algunos errores ocasionales, solo tres o cuatro de las docenas de personas que comentaron su primera publicación en Hacker News mostraron sospechas de que podía haber sido generado por un algoritmo. Todos esos comentarios fueron inmediatamente criticados por otros miembros de la comunidad.

Para los expertos, esta ha sido la preocupación que suscitan estos algoritmos de generación de lenguaje desde hace mucho tiempo. Y desde que OpenAI anunció por primera vez el modelo GPT-2, se ha comentado que era vulnerable al abuso. En su propia publicación de blog, el laboratorio destacó el potencial de esta herramienta de inteligencia artificial para convertirse en un arma de producción masiva de desinformación. Otros se han preguntado si podría usarse para producir publicaciones de spam llenas de palabras clave para engañar a Google.

Porr cree que su experimento también muestra un uso más banal, pero preocupante de todos modos: la herramienta podría usarse para generar una gran cantidad de contenido clickbait. "Es posible que haya una avalancha de contenido de blog mediocre porque ahora la barrera de entrada es más fácil", opina. "Creo que el valor del contenido online se reducirá bastante".

Porr planea hacer más experimentos con GPT-3, pero todavía está esperando obtener acceso a OpenAI. "Puede que estén molestos porque hice esto", reflexiona. "Quiero decir, es un poco tonto".