Si sigues las noticias sobre IA, probablemente te sientas zarandeado por el torbellino de informaciones contradictorias. La IA es una fiebre del oro. La IA es una burbuja. La IA te está quitando el trabajo. La IA ni siquiera sabe leer un reloj. El Índice de IA de 2026 del Instituto de Inteligencia Artificial Centrada en el Ser Humano de la Universidad de Stanford, el informe anual de la IA, se publica hoy y disipa parte de ese ruido.

A pesar de las predicciones de que el desarrollo de la IA podría topar con un muro, el informe afirma que los modelos más avanzados no paran de mejorar. La gente está adoptando la IA más rápido de lo que adoptó el ordenador personal o inte et. Las empresas de IA están generando ingresos a mayor velocidad que las compañías en cualquier auge tecnológico anterior, pero también están gastando cientos de miles de millones de dólares en centros de datos y chips. Los parámetros de referencia diseñados para medir la IA, las políticas destinadas a regularla y el mercado laboral están teniendo dificultades para seguir el ritmo. La IA avanza a toda velocidad, y el resto de nosotros intentamos encontrar nuestros zapatos.

Toda esa velocidad conlleva un coste. Los centros de datos de IA de todo el mundo pueden ahora consumir 29,6 gigavatios de energía, suficiente para abastecer a todo el estado de Nueva York en hora punta. El consumo anual de agua solo por el funcionamiento de GPT-4o de OpenAI podría superar las necesidades de agua potable de 12 millones de personas. Al mismo tiempo, la cadena de suministro de chips es alarmantemente frágil. Estados Unidos alberga la mayoría de los centros de datos de IA del mundo, y una empresa en Taiwán, TSMC, fabrica casi todos los chips de IA punteros.

Los datos revelan una tecnología que evoluciona más rápido de lo que podemos gestionar. A continuación, repasamos algunos de los puntos clave del informe de este año.

EE UU y China, prácticamente empatados

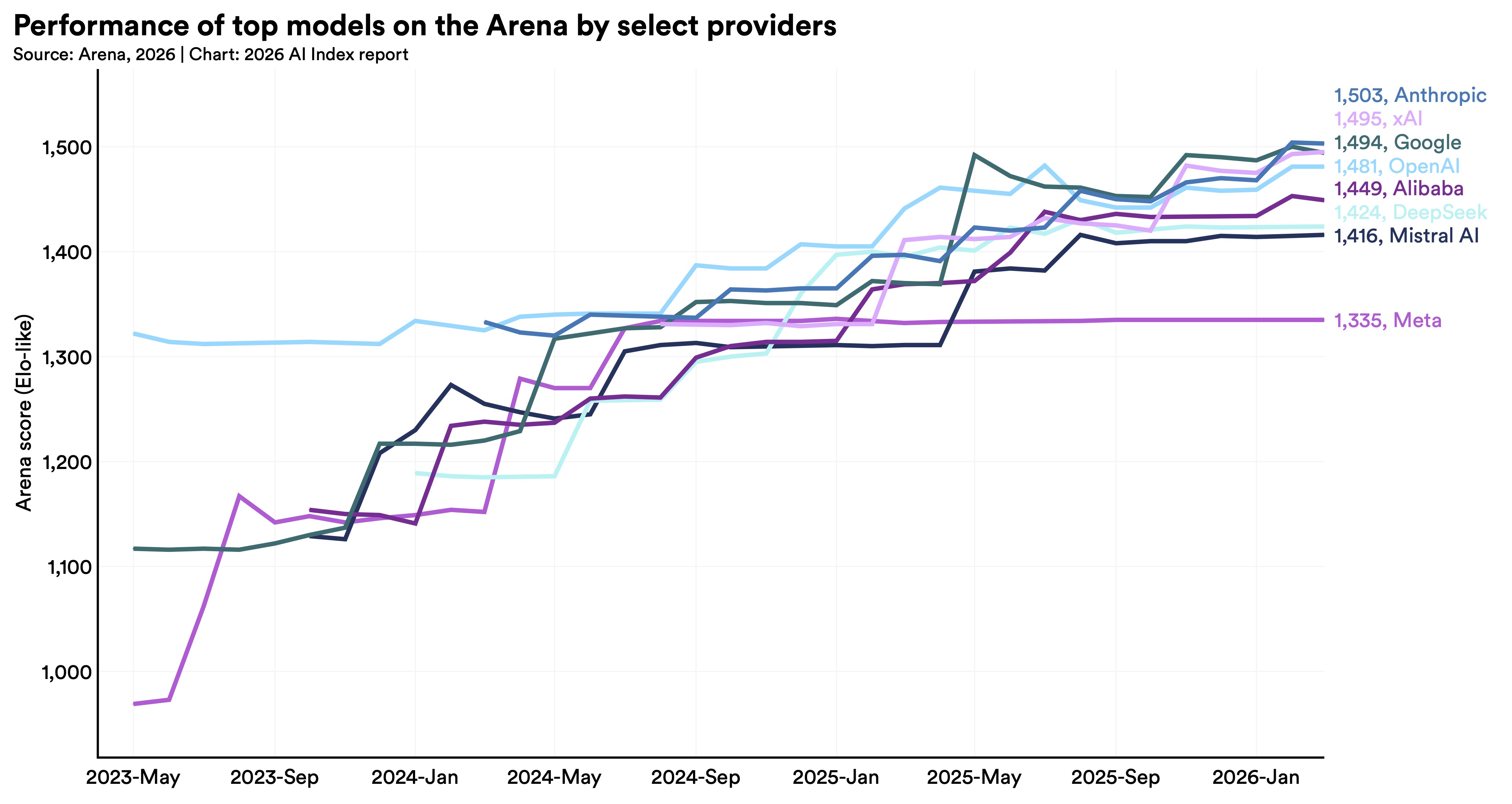

En una larga y enca izada carrera con inmensas implicaciones geopolíticas, EE UU y China están prácticamente a la par en el rendimiento de los modelos de IA, según Arena, una plataforma de clasificación impulsada por la comunidad que permite a los usuarios comparar los resultados de grandes modelos de lenguaje con indicaciones idénticas. A principios de 2023, OpenAI llevaba la delantera con ChatGPT, pero esta brecha se redujo en 2024 a medida que Google y Anthropic lanzaban sus propios modelos. En febrero de 2025, R1, un modelo de IA desarrollado por el laboratorio chino DeepSeek, igualó brevemente al principal modelo estadounidense, ChatGPT. A fecha de marzo de 2026, Anthropic lidera, seguido de cerca por xAI, Google y OpenAI. Modelos chinos como DeepSeek y Alibaba solo muestran un modesto rezago. Con los mejores modelos de IA separados en las clasificaciones por márgenes mínimos, ahora compiten en coste, fiabilidad y utilidad en el mundo real.

El índice señala que Estados Unidos y China tienen ventajas distintas en IA. Mientras que Estados Unidos cuenta con modelos de IA más potentes, más capital y unos 5.427 centros de datos estimados (más de 10 veces la cantidad de cualquier otro país), China lidera en publicaciones de investigación en IA, patentes y robótica.

A medida que la competencia se intensifica, empresas como OpenAI, Anthropic y Google ya no revelan su código de entrenamiento, el recuento de parámetros ni el tamaño de sus conjuntos de datos. "Desconocemos muchas cosas sobre la predicción del comportamiento de los modelos", afirma Yolanda Gil, científica informática de la Universidad del Sur de Califo ia, coautora del informe. Esta falta de transparencia dificulta a los investigadores independientes el estudio de cómo hacer que los modelos de IA sean más seguros, añade.

Los modelos de IA están avanzando a pasos agigantados

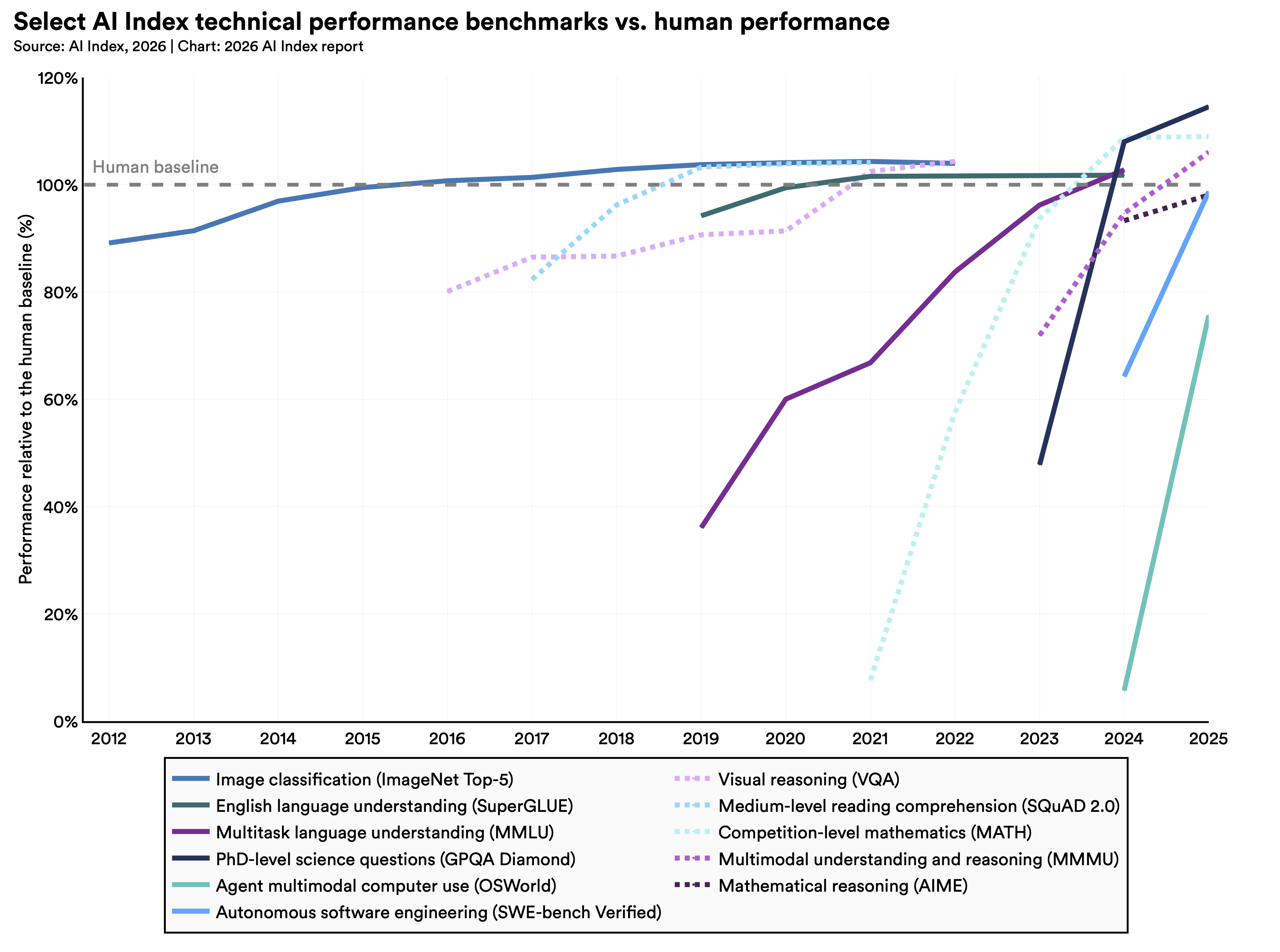

A pesar de las predicciones de que el desarrollo se estancaría, los modelos de IA siguen mejorando cada vez más. Según algunas métricas, ahora igualan o superan el rendimiento de los expertos humanos en pruebas que buscan medir la comprensión científica, matemática y lingüística a nivel de doctorado. SWE-bench Verified, un benchmark de ingeniería de software para modelos de IA, vio cómo las puntuaciones más altas saltaban de alrededor del 60% en 2024 a casi el 100% en 2025. En 2025, un sistema de IA produjo una predicción meteorológica por sí solo.

"Me asombra que esta tecnología siga mejorando y que, sencillamente, no se esté estancando de ninguna manera", dice Gil.

Sin embargo, la IA todavía encuentra dificultades en muchas otras áreas. Dado que los modelos aprenden procesando enormes cantidades de texto e imágenes en lugar de experimentar el mundo físico, la IA exhibe una "inteligencia irregular". Los robots todavía están en sus primeras etapas y solo tienen éxito en el 12% de las tareas domésticas. Los coches autónomos están más avanzados: los Waymo ya circulan por cinco ciudades estadounidenses, y los vehículos Apollo Go de Baidu están transportando pasajeros por China. La IA también se está expandiendo a ámbitos profesionales como el derecho y las finanzas, pero ningún modelo domina esos campos todavía.

La forma en que probamos la IA está rota

Estos informes de progreso deben tomarse con cautela. Los benchmarks diseñados para seguir el progreso de la IA tienen dificultades para seguir el ritmo a medida que los modelos superan rápidamente sus límites, según el informe de Stanford. Algunos están mal construidos: un benchmark popular que evalúa las habilidades matemáticas de un modelo tiene una tasa de error del 42%. Otros se pueden manipular: cuando los modelos se entrenan con datos de prueba de los benchmarks, por ejemplo, pueden aprender a obtener buenos resultados sin volverse más inteligentes.

Las empresas de IA también están compartiendo menos información sobre cómo se entrenan sus modelos, y las pruebas independientes a veces arrojan resultados distintos a los que reportan. "Muchas empresas no están revelando cómo se comportan sus modelos en ciertos benchmarks, particularmente en los benchmarks de IA responsable", dice Gil. "La ausencia de cómo se comporta tu modelo en un benchmark quizás dice algo".

La IA está empezando a afectar a los empleos

En los tres años desde su generalización, la IA es utilizada ya por más de la mitad de las personas en todo el mundo, una tasa de adopción más rápida que la del ordenador personal o inte et. Se estima que el 88% de las organizaciones utiliza ahora la IA, y cuatro de cada cinco estudiantes universitarios la usan.

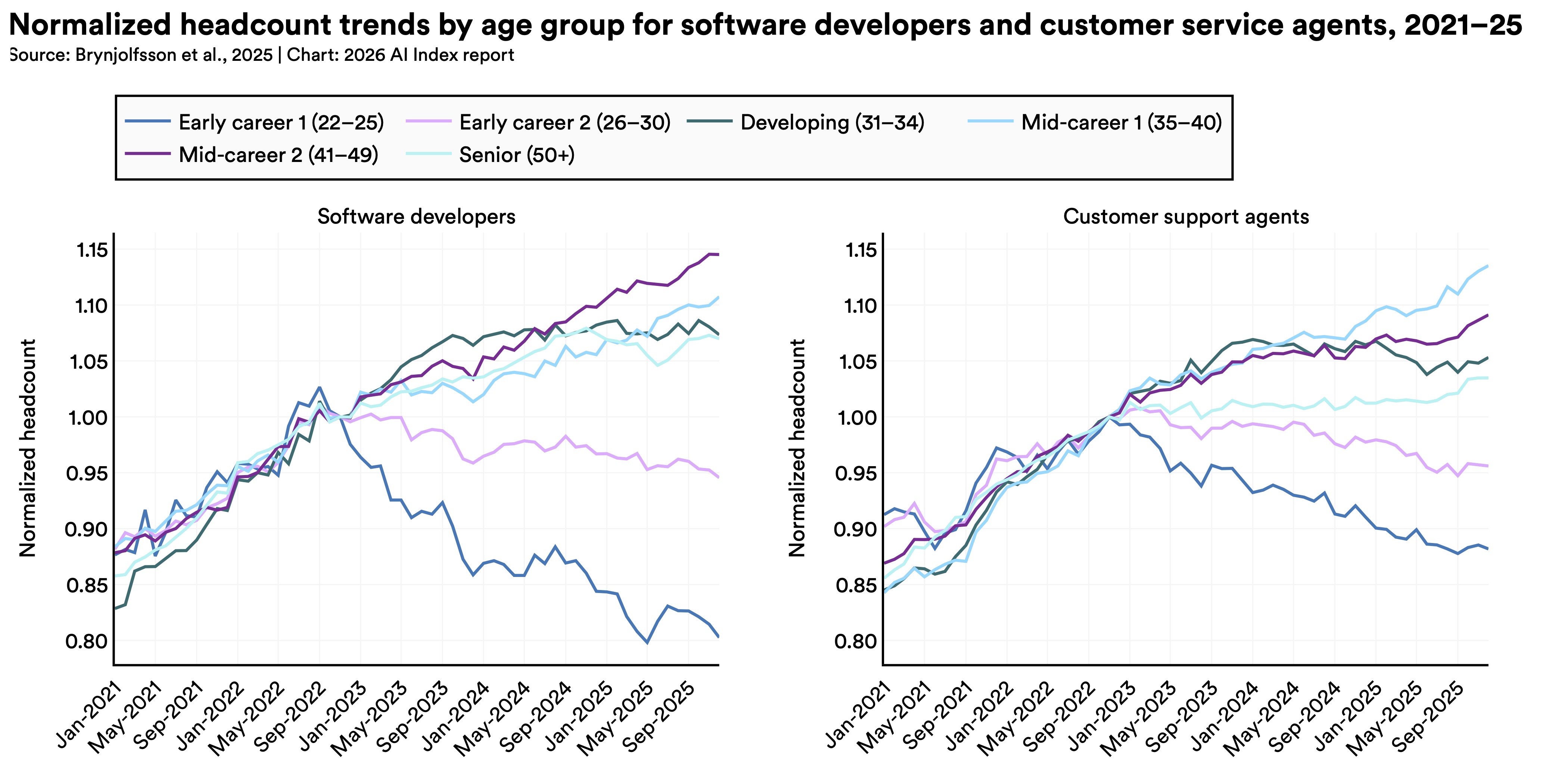

Su implementación está en sus primeras fases, y el impacto de la IA en los puestos de trabajo es difícil de medir. Aun así, algunos estudios sugieren que la IA está empezando a afectar a los trabajadores jóvenes en ciertas profesiones. Según un estudio de 2025 realizado por economistas de Stanford, el empleo para desarrolladores de software de entre 22 y 25 años ha caído casi un 20% desde 2022. La disminución podría no atribuirse únicamente a la IA, ya que las condiciones macroeconómicas más amplias podrían ser las culpables, pero la IA parece estar desempeñando un papel.

Los empleadores afirman que la contratación podría seguir complicándose. Según una encuesta de 2025 realizada por McKinsey & Company, un tercio de las organizaciones espera que la IA reduzca su plantilla en el próximo año, particularmente en operaciones de servicio y cadena de suministro, y en ingeniería de software. La IA está impulsando la productividad un 14% en atención al cliente y un 26% en desarrollo de software, según una investigación citada por el índice, pero tales ganancias no se observan en tareas que requieren mayor criterio. En general, todavía es demasiado pronto para comprender el impacto económico más amplio de la IA.

La gente tiene sentimientos encontrados sobre la IA

En todo el mundo, las personas se sienten a la vez optimistas y ansiosas respecto a la IA: el 59% cree que aportará más beneficios que inconvenientes, mientras que el 52% afirma que les genera nerviosismo, según una encuesta de Ipsos citada en el índice.

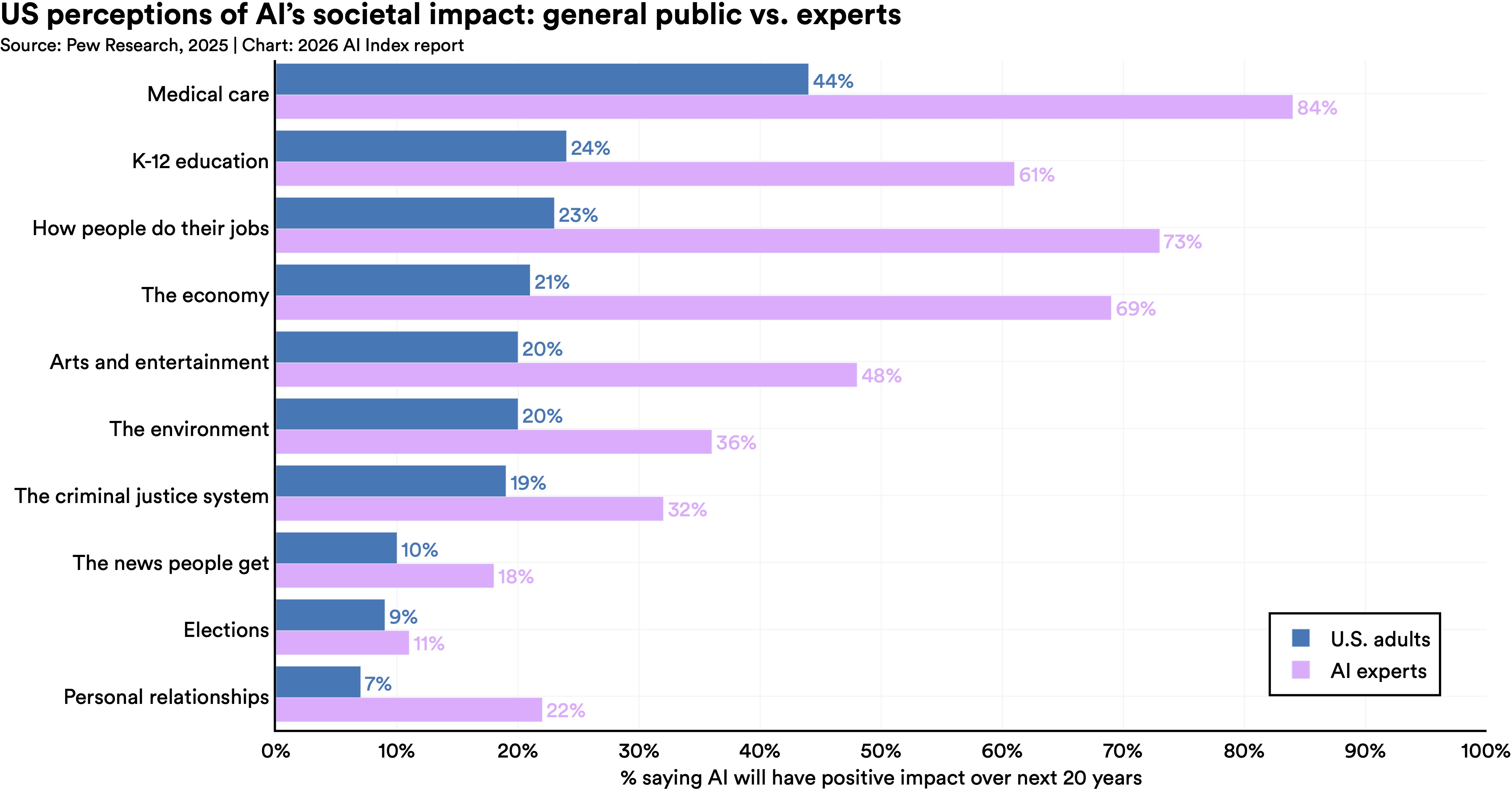

Cabe destacar que los expertos y el público ven el futuro de la IA de manera muy diferente, según una encuesta de Pew. La mayor brecha se observa en to o al futuro del trabajo: mientras que el 73% de los expertos cree que la IA tendrá un impacto positivo en la forma en que las personas realizan sus trabajos, solo el 23% del público estadounidense así lo cree. Los expertos también son más optimistas que el público sobre el impacto de la IA en la educación y la atención médica, pero coinciden en que la IA perjudicará las elecciones y las relaciones personales.

De todos los países encuestados, los estadounidenses son los que menos confían en que su gobie o regule la IA de forma adecuada, según otra encuesta de Ipsos. Más estadounidenses se muestran preocupados por que la regulación federal de la IA no llegue lo suficientemente lejos que por que lo haga en exceso.

Los gobie os tienen dificultades para regular la IA

Los gobie os de todo el mundo tienen dificultades para regular la IA, pero el año pasado se lograron algunos éxitos menores. Las primeras prohibiciones del Reglamento de IA de la UE, que vetan el uso de la IA en la vigilancia predictiva y el reconocimiento de emociones, entraron en vigor. Japón, Corea del Sur e Italia también aprobaron leyes nacionales sobre IA. Mientras tanto, el Gobie o federal de EE UU avanzó hacia la desregulación, con el presidente Trump dictando una orden ejecutiva destinada a coartar a los estados para que no regulasen la IA.

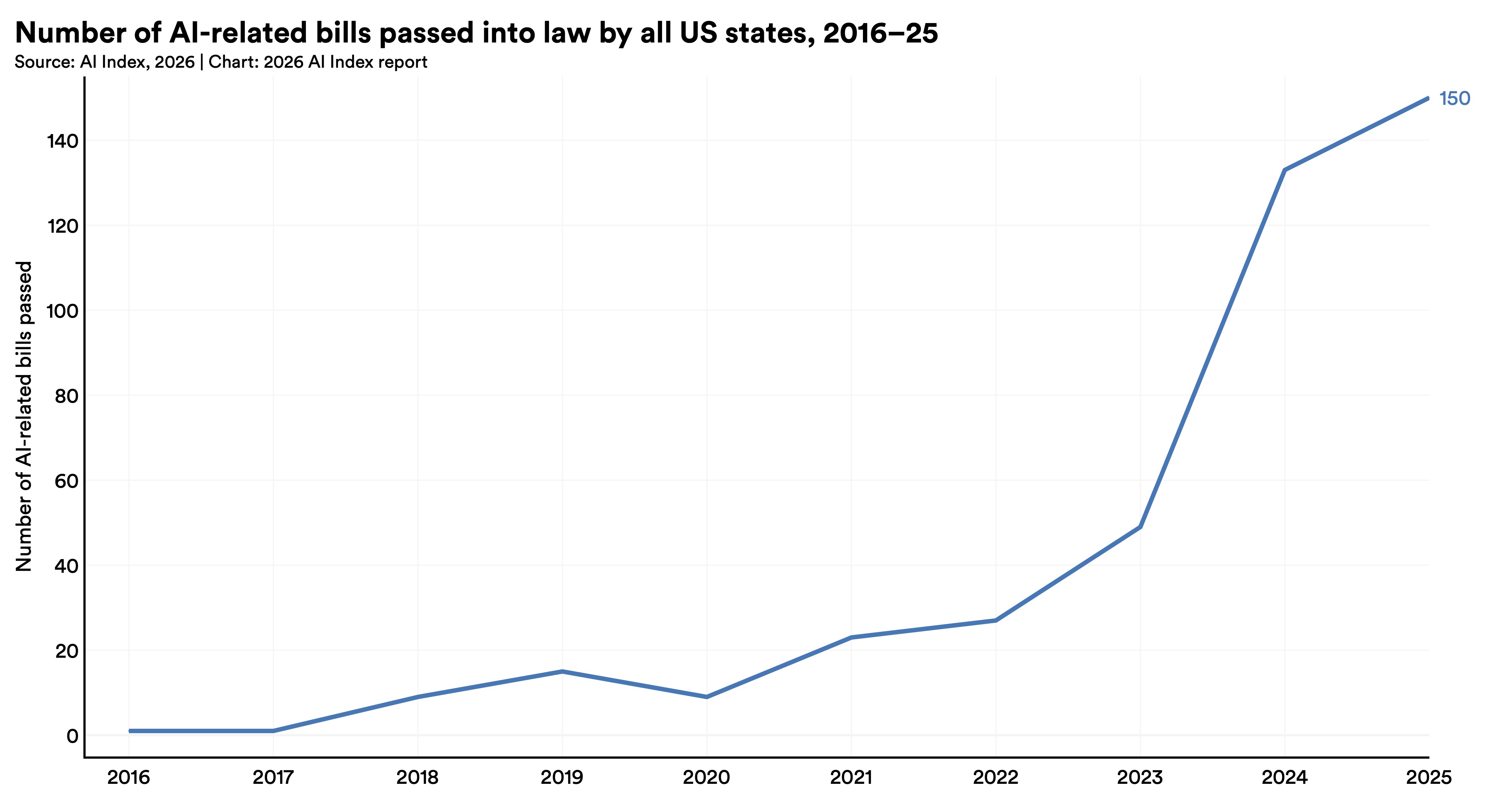

A pesar de esta acción federal, las legislaturas estatales en EE UU aprobaron un récord de 150 proyectos de ley relacionados con la IA. Califo ia promulgó una legislación histórica, incluyendo la SB 53, que exige la divulgación de información sobre seguridad y protecciones para denunciantes para los desarrolladores de modelos de IA. Nueva York aprobó la Ley RAISE, exigiendo a las empresas de IA que publiquen protocolos de seguridad y que informen sobre incidentes críticos de seguridad.

Pero, a pesar de la intensa actividad legislativa, la regulación va por detrás de la tecnología porque no entendemos realmente cómo funciona, según Gil. "Los gobie os son cautelosos a la hora de regular la IA porque no entendemos bien muchas cosas", afirma. "No tenemos un buen control sobre esos sistemas".