Inteligencia Artificial

La inteligencia artificial lee la mente para averiguar lo que observan los ojos

La información que llega a la corteza visual puede ser analizada para reconstruir la imagen que observa el usuario. La nueva técnica, basada en aprendizaje profundo, ha superado a todos los enfoques anteriores y podría acelerar el desarrollo de interfaces cerebro-ordenador

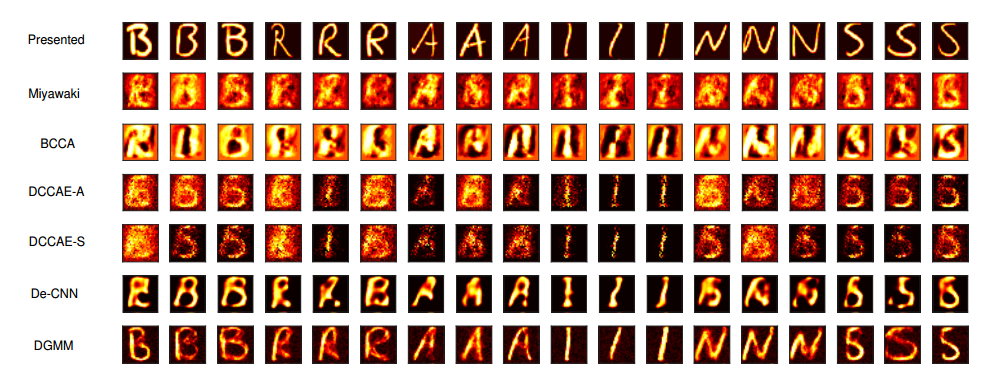

Foto: comparativa de técnicas de reconstrucción de imágenes cerebrales. Las imágenes originales ocupan la fila superior, mientras que los resultados del nuevo modelo ocupan la fila inferior.

Uno de los objetivos más interesantes de la neurociencia consiste en reconstruir las imágenes observadas mediante el análisis de imágenes cerebrales. La idea consiste en averiguar qué ve la gente mediante la monitorización de la actividad de su corteza frontal.

La dificultad, por supuesto, reside en procesar los datos de imágenes de resonancia magnética funcional (IRMf) con eficacia. La tarea consiste en mapear los vóxeles tridimensionales del cerebro en forma de píxeles bidimensionales en una imagen.

Pero esta labor es muy complicada. Las imágenes de IRMf contienen mucho ruido, y se sabe que la actividad de un vóxel está influida por la actividad de otros vóxeles. Este tipo de correlación resulta computacionalmente cara. De hecho, la mayoría de los enfoques simplemente no lo hacen, lo cual reduce mucho la calidad de las imágenes reconstruídas.

Así que sería genial encontrar una forma mejor de procesar los datos procedentes de imágenes de IRMf para producir reconstrucciones de imágenes cerebrales más precisas. Y eso es justo lo que está intentando el investigador del Centro de Investigaciones para la Inteligencia Inspirada en el Cerebro de Pekín (China) Changde Du, junto a varios compañeros. El equipo afirma haber desarrollado justo este tipo de técnica. Su enfoque consiste en procesar los datos mediante aprendizaje profundo, capaz de abordar las correlaciones no lineales entre vóxeles de manera más hábil. El resultado es una manera mucho mejor de reconstruir la manera en la que el cerebro percibe las imágenes.

El equipo de Changde empezó con varios conjuntos de datos de imágenes de IRMf de la corteza visual de un humano que miraba una imagen sencilla, por ejemplo, un único dígito o letra. Cada conjunto de datos incluye tanto las imágenes cerebrales como las observadas por el sujeto.

La tarea consiste en encontrar una manera de emplear las imágenes de IRMf para reproducir la imagen percibida. En total, el equipo disponía de más de 1.800 imágenes de IRMf e imágenes originales. Y las asumieron como una sencilla tarea de aprendizaje de máquinas. Utilizaron el 90% de los datos para entrenar la red para entender la correlación entre la imagen cerebral y la imagen original. Y después probaron la red con los datos restantes. La alimentaron con las imágenes cerebrales y le encargaron que reconstruyera la imagen original.

La gran ventaja de este enfoque es que la red aprende qué vóxeles debe tener en cuenta para reconstruir la imagen. Eso evita la necesidad de procesar los datos de todos ellos.

También es capaz de averiguar cómo los datos de estos vóxeles están correlacionados. Este elemento es importante ya que si se ignoran las correlaciones, se asumen como ruido y se descartan. Así que el nuevo enfoque, bautizado como modelo generativo profundo multivista (DGGM, por sus siglas en inglés), se aprovecha de estas correlaciones y las distingue del ruido de verdad.

Para evaluar la eficacia del sistema, el equipo de Changde comparó sus resultados con otras técnicas de reconstrucción de imágenes cerebrales mediante métodos estándares de comparación de imágenes para averiguar cuales concordaban mejor con la imagen original.

Los resultados son interesantes. En general, las imágenes reconstruidas son un reflejo claro de las originales. En muchos casos, son significativamente más precisas que los resultados de otras técnicas. Y las métricas de comparación de imágenes lo confirman. La investigación afirma: "Exhaustivas comparaciones experimentales demuestran que nuestro enfoque puede reconstruir imágenes visuales de mediciones de IRMf con mayor precisión".

Es un trabajo interesante con importantes implicaciones. La capacidad de reconstruir imágenes cerebrales es un importante hito para desarrollar mejores interfaces cerebro-máquina. Los próximos pasos incluirán maneras de analizar escenas más complejas e imágenes en movimiento. El equipo de Changde señala que su enfoque también podría ser aplicado a otros problemas de codificación cerebral como el audio y las tareas físicas.

Más allá de eso, ¿quién sabe? Desde aquí, solo queda un corto salto de imaginación para técnicas de imágenes cerebrales que revelen lo que esté pensando o soñando la gente. ¡Imagínese!

Ref: arxiv.org/abs/1704.07575: Sharing Deep Generative Representation for Perceived Image Reconstruction from Human Brain Activity