Inteligencia Artificial

El envenenamiento de datos, la estrategia para proteger los derechos de artistas ante la IA

La herramienta Nightshade desordena los datos de entrenamiento para causar graves daños a los modelos de IA generadores de imágenes

Una nueva herramienta permite a los artistas añadir cambios invisibles a los píxeles de sus obras antes de subirlas a internet. De esta forma, si se incorporan a un conjunto de entrenamiento de inteligencia artificial (IA), el modelo resultante puede romperse de forma caótica e impredecible.

Nightshade es la herramienta que pretende luchar contra las empresas de IA que utilizan obras de artistas para entrenar sus modelos sin el permiso del creador. Utilizarla para "envenenar" estos datos de entrenamiento podría dañar futuras iteraciones de modelos de IA generadores de imágenes, como DALL-E, Midjourney y Stable Diffusion, haciendo que algunos de sus resultados sean inútiles, como convertir perros en gatos, coches en vacas, etc. MIT Technology Review obtuvo un adelanto exclusivo de la investigación, que se ha sometido a revisión por pares en la conferencia de seguridad informática Usenix.

OpenAI, Meta, Google y Stability AI se enfrentan a una serie de demandas de artistas que alegan que su material protegido por derechos de autor y su información personal han sido sustraídos sin consentimiento ni compensación. Ben Zhao, profesor de la Universidad de Chicago (EE UU), que dirigió el equipo detrás de Nightshade, tiene la esperanza de que esta herramienta ayude a inclinar la balanza de poder de nuevo de las empresas de IA hacia los artistas. Su objetivo es crearun elemento disuasorio contra la violación de los derechos de autor y la propiedad intelectual de los artistas. Meta, Google, Stability AI y OpenAI no han respondido a la petición de MIT Technology Review sobre cómo podrían actuar ante esta herramienta.

El equipo de Zhao también ha desarrollado Glaze, una herramienta que permite a los artistas "enmascarar" su estilo personal para evitar que las empresas de IA lo copien . Funciona de forma similar a Nightshade: cambiando los píxeles de las imágenes de formas sutiles que son invisibles para el ojo humano, pero manipulan los modelos de aprendizaje automático para interpretar la imagen como algo distinto de lo que muestra en realidad.

El equipo pretende integrar Nightshade en Glaze, y los artistas podrán elegir si quieren utilizar la herramienta de envenenamiento de datos o no. Además, planean que Nightshade sea de código abierto, algo que permitiría que otros la utilizaran y crearan sus propias versiones. Cuanta más gente la utilice y cree sus propias versiones, más potente será la herramienta, afirma Zhao. Los conjuntos de datos de los grandes modelos de IA pueden constar de miles de millones de imágenes, por lo que cuantas más imágenes alteradas en el modelo, más daño causará la técnica.

Un ataque dirigido

Nightshade aprovecha una vulnerabilidad de seguridad de los modelos generativos de IA, derivada del hecho de que se entrenan con grandes cantidades de datos (en este caso, imágenes que se han obtenido de internet). Nightshade manipula esas imágenes.

Los artistas que quieran compartir sus obras a internet, pero no quieran que las empresas de IA rastreen sus imágenes pueden subirlas a Glaze y optar por enmascararlas con un estilo artístico distinto al suyo o utilizar Nightshade. Cuando los desarrolladores de IA obtienen más datos de internet con los que ajustar un modelo de IA existente o crear uno nuevo, estas muestras alteradas se cuelan en el conjunto de datos del modelo y provocan su mal funcionamiento.

Las muestras de datos envenenados pueden manipular los modelos para que aprendan, por ejemplo, que las imágenes de sombreros son pasteles y las de bolsos son tostadoras. Los datos envenenados son muy difíciles de eliminar, ya que requiere que las empresas tecnológicas encuentren y eliminen cada muestra corrupta de forma minuciosa.

Los investigadores probaron el ataque con los últimos modelos de Stable Diffusion y con un modelo de IA que entrenaron desde cero. Cuando alimentaron a Stable Diffusion con solo 50 imágenes envenenadas de perros y luego le pidieron que creara imágenes de perros, el resultado fue extraño: criaturas con demasiadas extremidades y caras caricaturescas. Con 300 muestras envenenadas, un atacante puede manipular Stable Diffusion para generar imágenes de perros que parezcan gatos.

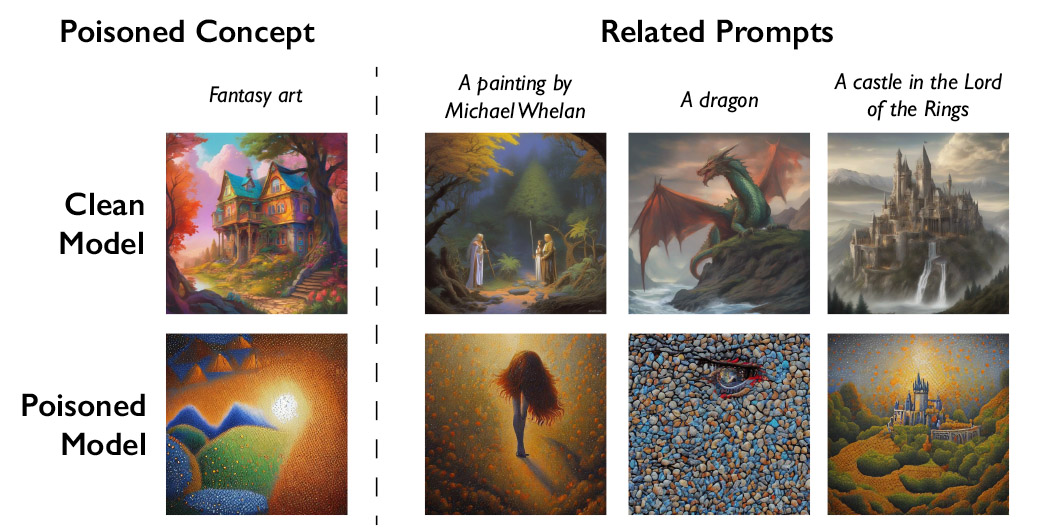

Los modelos generativos de IA son excelentes para establecer conexiones entre palabras, algo que ayuda a la propagación del veneno. Nightshade no solo infecta la palabra "perro", sino todos los conceptos similares, como "cachorro", "husky" y "lobo". El ataque del veneno también funciona en imágenes relacionadas de manera tangencial. Por ejemplo, si el modelo raspase una imagen envenenada para la indicación "arte fantástico", las indicaciones "dragón" y "un castillo en El Señor de los Anillos" también serían manipuladas para convertirse en otra cosa.

Zhao admite que existe el riesgo de que se abuse de la técnica de envenenamiento de datos para usos malintencionados. Sin embargo, afirma que los atacantes necesitarían miles de muestras envenenadas para infligir un daño real a los modelos más grandes y potentes, ya que se entrenan con miles de millones de muestras de datos.

"Aún no conocemos defensas sólidas contra estos ataques. Todavía no hemos visto ataques de envenenamiento contra modelos modernos [de aprendizaje automático], pero podría ser cuestión de tiempo", afirma Vitaly Shmatikov, profesor de la Universidad de Cornell (EE UU) que estudia la seguridad de los modelos de IA y no participó en la investigación. "El momento de trabajar en las defensas es ahora", añade Shmatikov.

Gautam Kamath, profesor adjunto de la Universidad de Waterloo (Canadá), que investiga la privacidad de los datos y la solidez de los modelos de IA y no participó en el estudio, afirma que el trabajo es "fantástico".

La investigación demuestra que las vulnerabilidades "no desaparecen por arte de magia en estos nuevos modelos y, de hecho, no hacen sino agravarse", afirma Kamath. "Es especialmente cierto a medida que estos modelos se hacen más poderosos y la gente confía más en ellos, ya que lo que está en juego aumenta con el tiempo".

Un gran elemento disuasorio

Junfeng Yang, profesor de informática de la Universidad de Columbia (EE UU) y especialista en seguridad de los sistemas de aprendizaje profundo que no participó en el trabajo, sostiene que Nightshade podría tener una gran repercusión si consigue que las empresas de IA respeten más los derechos de los artistas, por ejemplo, estando dispuestas a pagar derechos de autor.

Las empresas de IA que han desarrollado modelos generativos de texto a imagen, como Stability AI y OpenAI, han ofrecido a los artistas la posibilidad de que sus imágenes no se utilicen para entrenar futuras versiones de los modelos. Sin embargo, los artistas consideran que no es suficiente. Eva Toorenent, ilustradora y artista que ha utilizado Glaze, afirma que las políticas de exclusión obligan a los artistas a pasar por el aro y dejan a las empresas tecnológicas todo el poder.

Toorenent espera que Nightshade cambie el statu quo. "Va a hacer que [las empresas de IA] se lo piensen dos veces, porque tienen la posibilidad de destruir todo su modelo quedándose con nuestro trabajo sin nuestro consentimiento", señala.

Autumn Beverly, otra artista, afirma que herramientas como Nightshade y Glaze le han dado confianza para volver a publicar sus obras online. Anteriormente, las había retirado de internet tras descubrir que había sido incorporada a la popular base de datos de imágenes LAION sin su consentimiento.

"Estoy muy agradecida de que dispongamos de una herramienta que ayude a devolver el poder a los artistas sobre su propio trabajo", concluye.