Una pareja de sistemas de inteligencia artificial trabajando a dúo puede adquirir imaginación al jugar al gato y al ratón con datos

-

¿Qué? Dos sistemas de inteligencia artificial pueden interactuar entre sí para crear imágenes y sonidos originales ultrarrealistas; algo que las máquinas nunca habían sido capaces de hacer.

-

¿Por qué? Esta tecnología confiere a las máquinas una especie de sentido de imaginación, lo que puede ayudar a que sean menos dependientes de los humanos, pero que a su vez las convierte en herramientas preocupantemente poderosas para la falsificación digital.

-

¿Quién? Google Brain, DeepMind, Nvidia.

-

¿Cuándo? Ya.

La inteligencia artificial cada vez es más capaz de identificar cosas: enséñele un millón de fotos y podrá decirle con asombrosa precisión en cuáles aparece un peatón cruzando una calle. Y un coche autónomo puede enseñarse a conducir a sí mismo sin ni siquiera tener que pisar una carretera.

El problema es que para crear algo completamente nuevo hace falta imaginación, algo que hasta ahora ha dejado perpleja a cualquier inteligencia artificial. La primera solución se le ocurrió al entonces estudiante de doctorado en la Universidad de Montreal (Canadá) Ian Goodfellow, durante un debate académico en un bar en 2014.

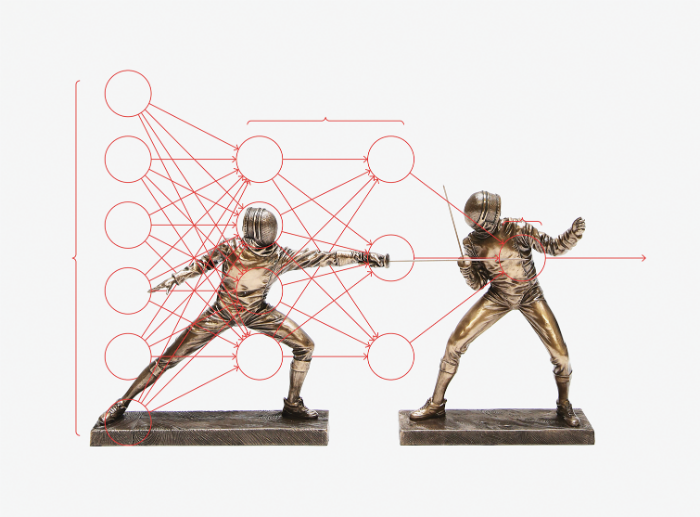

El enfoque, conocido como redes generativas antagónicas (GAN, por sus siglas en inglés) emplea dos redes neuronales (modelos matemáticos simplificados del cerebro) y las enfrenta mutuamente en un juego digital del gato y el ratón.

Ambas redes están entrenadas con el mismo conjunto de datos. Una, conocida como la generativa, tiene la tarea de crear variaciones en las imágenes que ya ha visto, tal vez una imagen de un peatón con un brazo de más. La segunda, conocida como el discriminador, debe identificar si la imagen que está viendo pertenece al conjunto de entrenamiento original o, por el contrario, si es una imagen falsa producida por la red generativa. A la red discriminadora básicamente se hace la siguiente pregunta: ¿Es probable que esa persona con tres brazos sea real?

Con el tiempo, a la red generativa se le da tan bien producir imágenes que a su pareja discriminadora le resulta imposible detectar la falsificación. En resumen: la red generativa aprende a reconocer y posteriormente a crear imágenes de peatones de aspecto realista.

La tecnología se ha convertido en uno de los avances más prometedores de la inteligencia artificial en la última década, capaz de ayudar a las máquinas a producir resultados que engañan incluso a los humanos.

Los GAN se usaron para crear sonidos e imágenes hiperrealistas. En un convincente ejemplo, los investigadores del fabricante de chips Nvidia entrenaron a una GAN con fotografías de personas famosas para que el sistema fuera capaz de crear cientos de rostros creíbles de personas que no existen. Otro grupo de investigación consiguió generar pinturas falsas parecidas a las obras de Van Gogh. Si se les fuerza aún más, las GAN pueden reimaginar las imágenes de diferentes maneras: pueden hacer que una carretera soleada parezca nevada o convertir caballos en cebras.

Los resultados no siempre son perfectos: las GAN pueden crear bicicletas con dos tipos de manillar, por ejemplo, o caras con cejas en el lugar incorrecto. Pero debido a que las imágenes y los sonidos son, por lo general, asombrosamente realistas, algunos expertos creen que hay una lógica detrás de cómo las GAN comienzan a comprender la estructura subyacente del mundo que ven y oyen.

Esto significa que, además del sentido de la imaginación, la inteligencia artificial puede adquirir una habilidad más independiente para dar sentido a lo que ve en el mundo.