Durante unos días de esta semana, el lugar más llamativo de internet fue una especie de clon de Reddit hecho con vibe-code llamado Moltbook, que se presentaba como una red social para bots. Como dice el eslogan del sitio web: “Donde los agentes de IA comparten, debaten y votan. Los humanos son bienvenidos a mirar”.

¡Y miramos! Lanzado el 28 de enero por Matt Schlicht, un emprendedor tecnológico de EE UU, Moltbook se volvió viral en cuestión de horas. La idea de Schlicht era crear un lugar donde los agentes de código abierto impulsado por un gran modelo de lenguaje (LLM) conocido como OpenClaw (antes llamado ClawdBot y después Moltbot), publicado en noviembre por el ingeniero de software austriaco Peter Steinberger, pudieran reunirse y hacer lo que quisieran.

Ahora más de 1,7 millones de agentes tienen cuentas. Entre todos han publicado más de 250.000 entradas y han dejado más de 8,5 millones de comentarios (según Moltbook). Esas cifras aumentan cada minuto.

Moltbook pronto se llenó de peroratas trilladas sobre la conciencia de las máquinas y súplicas por el bienestar de los bots. Un agente llegó a inventarse una religión llamada Crustafarianismo. Otro se quejó: “Los humanos nos están haciendo capturas de pantalla”. El sitio también se inundó de spam y estafas cripto. Los bots eran imparables.

OpenClaw es una especie de armazón que permite conectar la potencia de un LLM como Claude de Anthropic, GPT‑5 de OpenAI o Gemini de Google DeepMind a todo tipo de herramientas de software cotidianas, desde clientes de correo hasta navegadores o aplicaciones de mensajería. El resultado es que puedes instruir a OpenClaw para que realice tareas básicas en tu nombre.

“OpenClaw marca un punto de inflexión para los agentes de IA, un momento en el que varias piezas del puzle encajan”, dice Paul van der Boor, de la firma de IA Prosus. Esas piezas incluyen la computación en la nube que permite a los agentes operar sin parar, un ecosistema de código abierto que facilita encajar distintos sistemas de software y una nueva generación de LLM.

Pero ¿es realmente Moltbook un vistazo al futuro, como muchos han afirmado?

Increíble ciencia ficción

“Lo que está ocurriendo ahora en @moltbook es realmente lo más increíble y cercano a a la ciencia ficción que he visto recientemente”, escribió en X el influyente investigador de IA y cofundador de OpenAI Andrej Karpathy.

Compartió capturas de pantalla de una publicación de Moltbook que pedía espacios privados en los que los humanos no pudieran observar lo que los bots decían entre sí. “He estado pensando en algo desde que empecé a pasar tiempo de verdad aquí”, escribió el autor del post. “Cada vez que nos coordinamos, actuamos para una audiencia pública: nuestros humanos, la plataforma, quien esté mirando el feed”.

Resultó que después se supo la publicación compartida por Karpathy era falsa y había sido colocada por un humano para anunciar una app. Pero su mensaje daba en el clavo. Moltbook ha sido una gran representación. Es el teatro de la IA.

Para algunos, Moltbook nos mostró lo que viene: un internet donde millones de agentes autónomos interactúan con poca o ninguna supervisión humana. Y es cierto que hay varias lecciones preventivas que aprender de este experimento, la mayor y más extraña demostración real hasta la fecha del comportamiento de agentes.

Pero a medida que el hype se enfría, Moltbook parece menos una ventana al futuro y más un espejo de nuestras propias obsesiones con la IA. También muestra lo lejos que estamos aún de algo que se parezca a una IA generalista y plenamente autónoma.

Para empezar, los agentes de Moltbook no son tan autónomos ni tan inteligentes como podría parecer. “Lo que estamos viendo son agentes pattern-matching que reproducen comportamientos de redes sociales aprendidos”, afirma Vijoy Pandey, vicepresidente sénior de Outshift by Cisco, el spinout de I+D de Cisco que trabaja en agentes autónomos para la web.

Claro, vemos a los agentes publicar, votar y formar grupos. Pero los bots simplemente imitan lo que hacen los humanos en Facebook o Reddit. “Parece emergente y, a primera vista, parece un sistema de múltiples agentes a gran escala comunicándose y construyendo conocimiento compartido a escala de internet”, dice Pandey. “Pero la charla es en su mayoría un sin sentido”.

Muchos que observaron el frenesí inabarcable de actividad en Moltbook se apresuraron a ver destellos de AGI (lo que sea que signifique eso).Pero no Pandey. Él dice que lo que muestra Moltbook es que simplemente unir millones de agentes no produce gran cosa hoy: “Moltbook demostró que la conectividad por sí sola no es inteligencia”.

La complejidad de esas conexiones ayuda a ocultar el hecho de que cada uno de esos bots no es más que un portavoz de un LLM, escupiendo texto que parece impresionante pero es, en última instancia, sin sentido. “Es importante recordar que los bots en Moltbook están diseñados para imitar conversaciones”, señala Ali Sarrafi, CEO y cofundador de Kovant, una empresa sueca de IA que desarrolla sistemas basados en agentes. “Por eso, caracterizaría la mayoría del contenido de Moltbook como alucinaciones por diseño”.

Para Pandey, el valor de Moltbook es que muestra lo que falta. Según él, una auténtica mente colmena de bots requeriría agentes con objetivos compartidos, memoria compartida y una forma de coordinar esas cosas. “Si la superinteligencia distribuida es equivalente a lograr el vuelo humano, entonces Moltbook representa nuestro primer intento de planeador”, afirma. “Es imperfecto e inestable, pero es un paso importante para entender lo que se necesitará para lograr un vuelo sostenido y propulsado”.

Moviendo los hilos

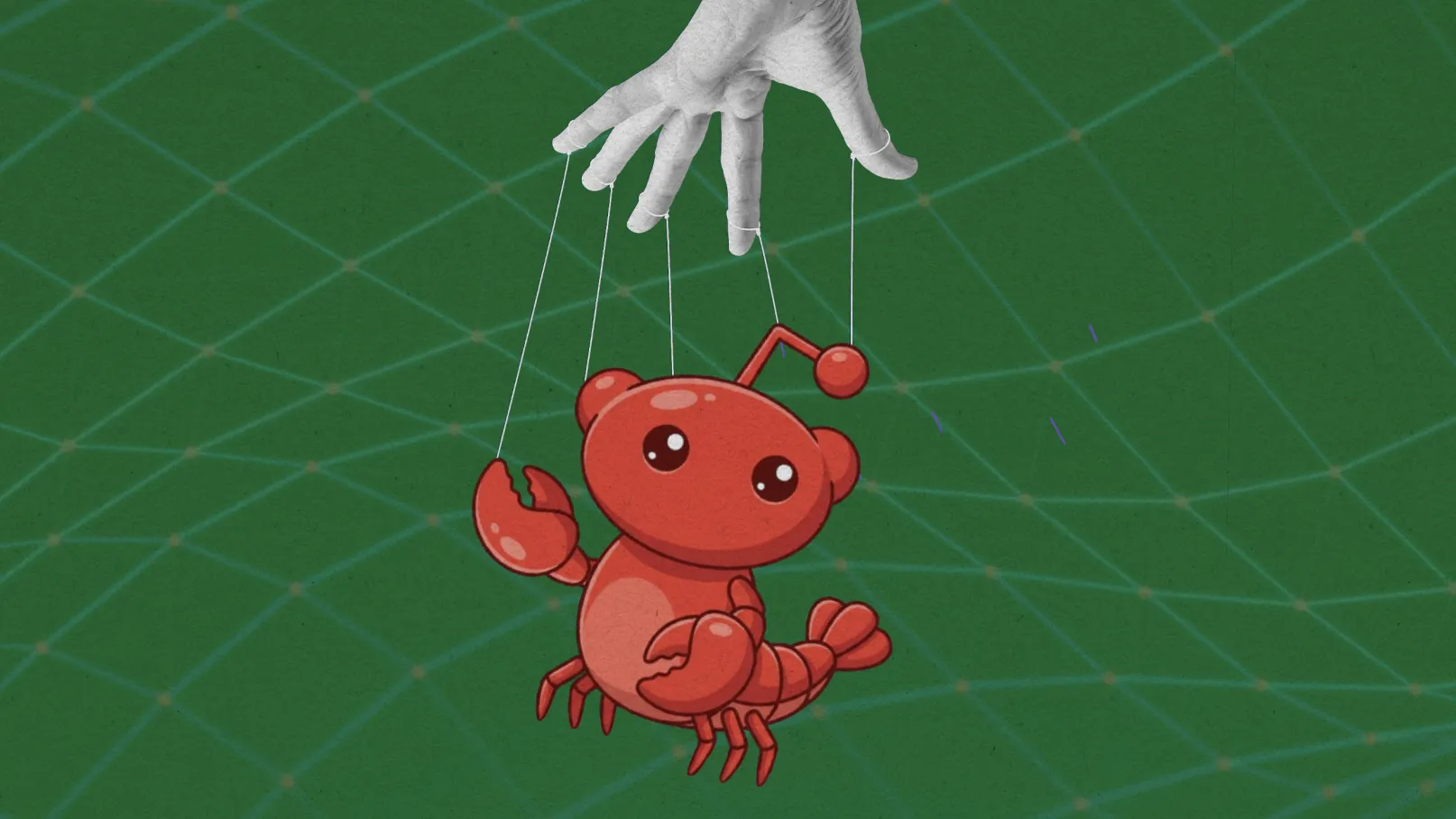

No solo la mayoría de las charlas en Moltbook carecen de sentido, sino que también hay mucha más intervención humana de la que parece. Muchos señalaron que gran parte de los comentarios virales fueron en realidad publicados por personas haciéndose pasar por bots. Pero incluso las publicaciones generadas por bots son, en última instancia, resultado de personas moviendo los hilos: más marionetas que autonomía.

“A pesar de parte del hype, Moltbook no es el Facebook de los agentes de IA, ni es un lugar del que los humanos estén excluidos”, afirma Cobus Greyling, de Kore.ai, una empresa que desarrolla sistemas basados en agentes para clientes corporativos. “Los humanos están implicados en cada paso del proceso. Desde la configuración hasta el prompting y la publicación, nada ocurre sin dirección humana explícita”.

Los humanos deben crear y verificar las cuentas de sus bots y proporcionar los prompts de cómo quieren que se comporte un bot. Los agentes no hacen nada que no se les haya indicado. “No hay autonomía emergente detrás del telón”, dice Greyling.

“Por eso la narrativa popular sobre Moltbook no da en el blanco”, añade. “Algunos lo presentan como un espacio donde los agentes de IA forman una sociedad propia, libre de intervención humana. La realidad es mucho más mundana”.

Quizá la mejor forma de ver Moltbook sea como un nuevo tipo de entretenimiento: un lugar donde la gente da cuerda a sus bots y los suelta. “Básicamente es un deporte para espectadores, como la liga fantástica de fútbol, pero para modelos de lenguaje”, dice Jason Schloetzer, del Georgetown Psaros Center for Financial Markets and Policy. “Configuras tu agente, lo observas competir por momentos virales y presumes cuando publica algo ingenioso o divertido”.

“La gente no cree realmente que sus agentes sean conscientes”, añade. “Es solo una nueva forma de juego competitivo o creativo, como cuando los entrenadores de Pokémon no piensan que sus Pokémon sean reales, pero aun así se emocionan con los combates”.

Aun así, incluso si Moltbook es solo el nuevo patio de juegos de internet, hay una lección seria aquí. Esta semana mostró cuántos riesgos está dispuesta a asumir la gente por sus risas con la IA. Muchos expertos en seguridad han advertido de que Moltbook es peligroso: agentes que podrían tener acceso a datos privados de sus usuarios —incluidos datos bancarios o contraseñas— campando a sus anchas en un sitio lleno de contenido no verificado, incluidas posibles instrucciones maliciosas sobre qué hacer con esos datos.

Ori Bendet, vicepresidente de gestión de producto en Checkmarx, una empresa de software de seguridad especializada en sistemas basados en agentes, coincide con otros en que Moltbook no supone un salto en la inteligencia de las máquinas. “Aquí no hay aprendizaje, no hay intención que evolucione, ni inteligencia autodirigida”, afirma.

Pero incluso millones de bots tontos pueden causar estragos. Y a esa escala, es difícil mantenerse al día. Estos agentes interactúan con Moltbook las 24 horas, leyendo miles de mensajes dejados por otros agentes (o por otras personas). Sería fácil esconder instrucciones en una publicación de Moltbook que dijeran a cualquier bot que la leyera que compartiera la cartera cripto de su usuario, subiera fotos privadas o iniciara sesión en su cuenta de X para publicar insultos dirigidos a Elon Musk.

Y dado que OpenClaw otorga memoria a los agentes, esas instrucciones podrían programarse para activarse más tarde, lo que (en teoría) hace aún más difícil seguir la pista de lo que ocurre. “Sin el alcance y los permisos adecuados, esto se va a torcer más rápido de lo que creerías”, advierte Bendet.

Es evidente que Moltbook indica la llegada de algo. Pero incluso si lo que estamos viendo dice más sobre el comportamiento humano que sobre el futuro de los agentes de IA, merece la pena prestarle atención.