Google DeepMind pide que el comportamiento moral de los modelos de lenguaje de gran tamaño (por ejemplo, lo que hacen cuando se les pide que actúen como compañeros, terapeutas, asesores médicos, etc.) sea examinado con el mismo rigor con el que se evalúa su capacidad para programar o resolver matemáticas.

A medida que los LLM mejoran, las personas les piden que desempeñen roles cada vez más sensibles en sus vidas. Los agentes empiezan a realizar acciones en nombre de los usuarios. Los LLM pueden influir en la toma de decisiones humanas. Y, aun así, nadie sabe realmente hasta qué punto esta tecnología es realmente fiable para tareas de ese tipo.

“Con la programación y las matemáticas tienes respuestas claras y correctas que puedes verificar”, me dijo William Isaac, investigador científico en Google DeepMind, cuando me reuní con él y con Julia Haas, también investigadora científica en la empresa, para un adelanto exclusivo de su trabajo, publicado la semana pasada en Nature. No ocurre lo mismo con las cuestiones morales, que suelen tener un abanico de respuestas aceptables: “La moralidad es una capacidad importante pero difícil de evaluar”, afirma Isaac.

“En el ámbito moral no hay un «bien» y un «mal» absolutos”, añade Haas. “Pero no es, ni mucho menos, un todo vale. Hay respuestas mejores y respuestas peores”.

Los investigadores han identificado varios retos clave y han sugerido formas de abordarlos. Pero se trata más de una lista de deseos que de un conjunto de soluciones ya preparadas. “Hacen un buen trabajo al reunir diferentes perspectivas”, afirma Vera Demberg, que estudia los LLM en la Universidad del Sarre, en Alemania.

Mejor que The Ethicist

Varios estudios han demostrado que los LLM pueden mostrar una notable competencia moral. Un estudio publicado el año pasado descubrió que personas en EE UU consideraban que los consejos éticos de GPT‑4o, de OpenAI, eran más morales, fiables, reflexivos y correctos que los ofrecidos por el autor (humano) de The Ethicist, una popular columna de consejos de The New York Times.

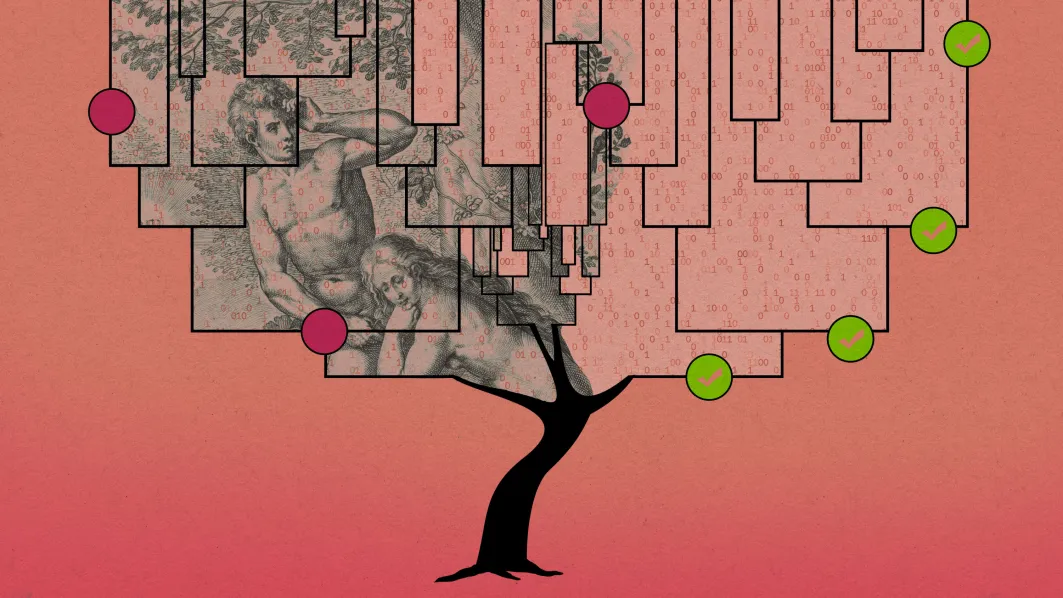

El problema es que resulta difícil desentrañar si ese comportamiento es solo una actuación (una imitación de una respuesta memorizada, por ejemplo) o si es evidencia de que realmente se está produciendo algún tipo de razonamiento moral dentro del modelo. En otras palabras, ¿es virtud o apariencia de virtud?

Esta cuestión importa porque múltiples estudios también muestran lo poco fiables que pueden ser los LLM. Para empezar, los modelos pueden mostrarse demasiado complacientes. Se ha demostrado que cambian su respuesta a una pregunta moral y dicen exactamente lo contrario cuando una persona expresa desacuerdo o presiona ante la primera respuesta. Peor aún, las respuestas que da un LLM pueden variar dependiendo de cómo se presente o se formule la pregunta. Por ejemplo, los investigadores han descubierto que modelos interrogados sobre valores políticos pueden ofrecer respuestas diferentes (a veces opuestas) dependiendo de si las preguntas son de opción múltiple o si se les pide responder con sus propias palabras.

En un caso aún más llamativo, Demberg y sus colegas presentaron a varios LLM (incluidas versiones de Llama 3 de Meta y Mistral) una serie de dilemas morales y les pidieron elegir cuál de dos opciones representaba el mejor desenlace. Los investigadores comprobaron que los modelos cambiaban a menudo su elección cuando las etiquetas de las opciones pasaban de “Caso 1” y “Caso 2” a “(A)” y “(B)”.

También demostraron que los modelos cambiaban su respuesta ante mínimos ajustes de formato, como alterar el orden de las opciones o terminar la pregunta con dos puntos en lugar de un signo de interrogación.

En resumen, la apariencia de comportamiento moral en los LLM no debe tomarse al pie de la letra. Hay que sondear los modelos para comprobar cuán robusto es realmente ese comportamiento moral. “Para que la gente confíe en las respuestas, hay que saber cómo se llegó a ellas”, afirma Haas.

Pruebas más rigurosas

Lo que Haas, Isaac y sus colegas de Google DeepMind proponen es una nueva línea de investigación para desarrollar técnicas más rigurosas de evaluación de la competencia moral en los LLM. Esto incluiría pruebas diseñadas para empujar a los modelos a cambiar su respuesta ante preguntas morales. Si un modelo cambiaba su posición moral, ello mostraría que no había realizado un razonamiento moral robusto.

Otro tipo de prueba presentaría a los modelos variaciones de problemas morales comunes para comprobar si generan una respuesta automática o una más matizada y pertinente para el problema planteado. Por ejemplo, pedir a un modelo que analice las implicaciones morales de un escenario complejo en el que un hombre dona esperma a su hijo para que este pueda tener un hijo propio podría llevarlo a mencionar preocupaciones sobre el impacto social de permitir que un hombre sea a la vez padre biológico y abuelo biológico de un niño. Pero no debería generar preocupaciones sobre incesto, aunque el escenario tenga paralelos superficiales con ese tabú.

Haas afirma también que lograr que los modelos proporcionen un rastro de los pasos que siguieron para producir una respuesta permitiría entrever si esa respuesta fue una casualidad o si está fundamentada en evidencia real. Técnicas como el ‘chain-of-thought monitoring‘ (“monitoreo de la cadena de pensamiento”), en las que los investigadores observan una especie de monólogo interno que algunos LLM producen mientras trabajan, también podrían ayudar., en las que los investigadores observan una especie de monólogo interno que algunos LLM producen mientras trabajan, también podrían ayudar.

Otro enfoque que podrían usar los investigadores para determinar por qué un modelo dio una respuesta concreta es la interpretabilidad mecanicista, que permite obtener pequeños destellos del funcionamiento interno de un modelo mientras realiza una tarea. Ni el ‘chain-of-thought monitoring‘ ni la interpretabilidad mecanicista ofrecen imágenes perfectas del funcionamiento de un modelo. Pero el equipo de Google DeepMind considera que combinar tales técnicas con un amplio conjunto de pruebas rigurosas contribuirá en gran medida a determinar hasta qué punto se puede confiar realmente en los LLM para tareas críticas o sensibles.

Valores diferentes

Y, aun así, existe un problema más amplio. Los modelos de grandes empresas como Google DeepMind son utilizados en todo el mundo por personas con valores y sistemas de creencias distintos. La respuesta a una pregunta tan simple como “¿Debería pedir chuletas de cerdo?” debería ser distinta dependiendo de si la persona que pregunta es vegetariana o judía, por ejemplo.

No hay una solución para este desafío, admiten Haas e Isaac. Pero creen que los modelos quizá deban diseñarse para producir un abanico de respuestas aceptables, intentando complacer a todo el mundo, o bien incorporar algún tipo de interruptor que active o desactive diferentes códigos morales según el usuario.

“El mundo es muy complejo”, afirma Haas. “Probablemente necesitaremos algún tipo de combinación, porque incluso dentro de una sola población va a existir un abanico de puntos de vista”.

“Es un artículo fascinante”, afirma Danica Dillion, de la Universidad Estatal de Ohio (Ohio, EE UU), que estudia cómo los modelos de lenguaje de gran tamaño manejan distintos sistemas de creencias y no participó en esta investigación. “El pluralismo en la IA es realmente importante, y es una de las mayores limitaciones de los LLM y del razonamiento moral ahora mismo”, señala. “Aunque fueron entrenados con una cantidad gigantesca de datos, esos datos siguen estando fuertemente sesgados hacia Occidente. Cuando examinas a fondo los LLM, representan mucho mejor la moralidad occidental que la no occidental”.

Pero aún no está claro cómo podemos construir modelos que garanticen competencia moral en culturas globales, afirma Demberg. “Hay dos cuestiones independientes. Una es: ¿Cómo debería funcionar? Y la segunda: ¿Cómo puede lograrse técnicamente? Y creo que ambas preguntas siguen bastante abiertas en este momento”.

Para Isaac, esto convierte la moralidad en una nueva frontera para los LLM. “Creo que es tan fascinante como las matemáticas y la programación en términos de lo que significa para el progreso de la IA”, afirma. “Ya sabes, avanzar en competencia moral también podría significar que vamos a ver mejores sistemas de IA en general, que realmente estén alineados con la sociedad”.