«¿Alguien quiere organizar una quedada en San Francisco (California, EE UU) y poner esto en una tele de 100 pulgadas?»

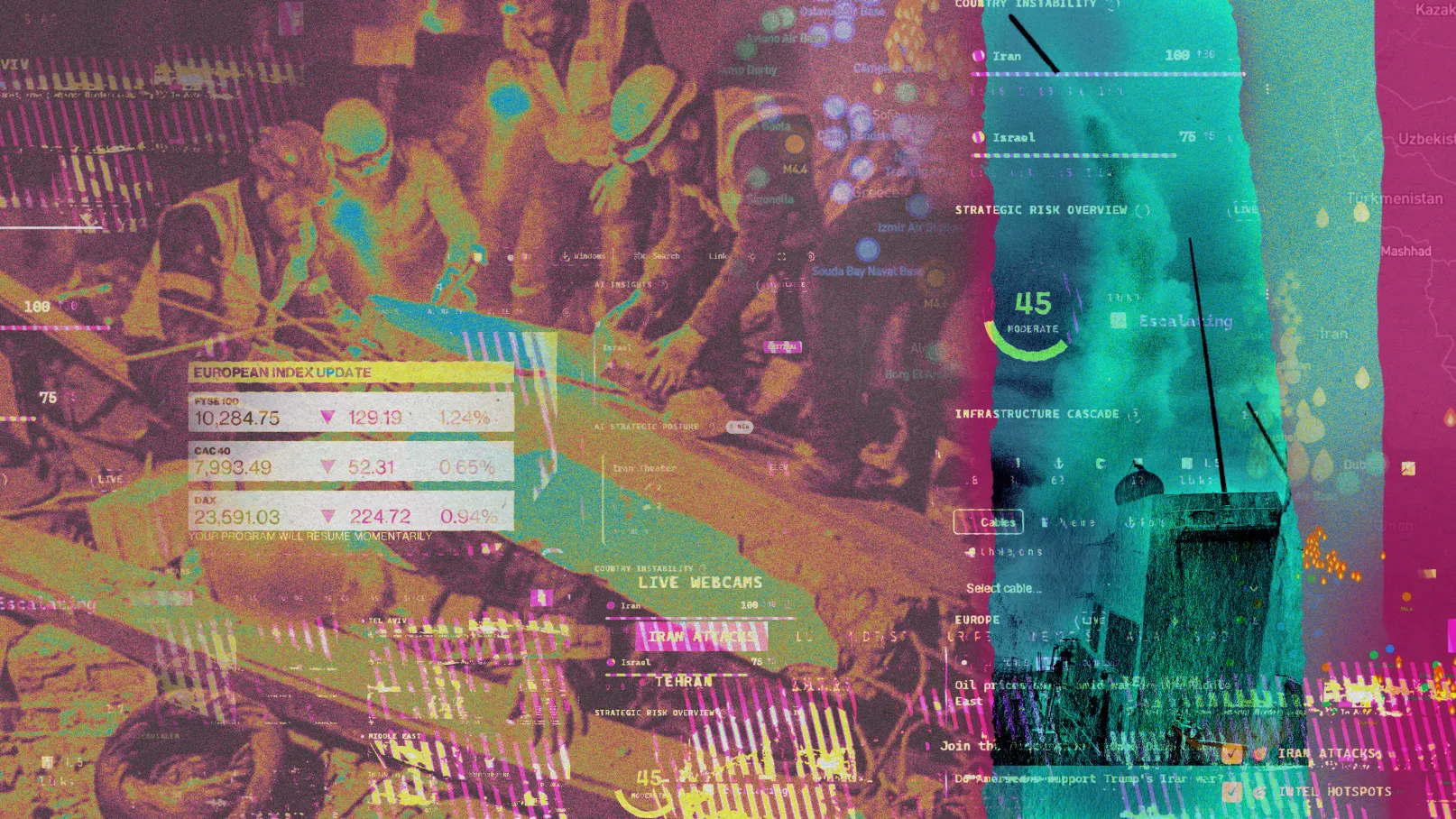

El autor de esa publicación en X se refería a un panel de inteligencia en línea que seguía en tiempo real los ataques de Estados Unidos e Israel contra Irán. Creado por dos personas de la firma de capital riesgo Andreessen Horowitz, combina datos de código abierto como imágenes por satélite y seguimiento de barcos con una función de chat, fuentes de noticias y enlaces a mercados de predicción, donde la gente puede apostar sobre cuestiones como quién será el próximo “líder supremo” de Irán (la reciente designación de Mojtaba Khamenei dio su rédito a algunos jugadores).

He revisado más de una docena de paneles similares en la última semana. Muchos fueron aparentemente generados por vibe coding en un par de días con ayuda de herramientas de IA, incluido uno que llamó la atención de un fundador del gigante de inteligencia Palantir, la plataforma a través de la cual el Ejército estadounidense accede a modelos de IA como Claude durante la guerra. Algunos fueron construidos antes del conflicto en Irán, pero casi todos están siendo promocionados por sus creadores como una forma de superar a los medios —lentos e ineficaces, según ellos— accediendo directamente a la verdad de lo que ocurre sobre el terreno. «Acabo de aprender más en 30 segundos viendo este mapa que leyendo o viendo cualquier cadena de noticias importante», escribió un comentarista en LinkedIn en respuesta a una visualización del cierre del espacio aéreo iraní antes de los ataques.

Buena parte de la atención sobre la IA y el conflicto en Irán se ha centrado, con razón, en el papel que modelos como Claude podrían estar desempeñando para ayudar al Ejército de Estados Unidos a decidir dónde atacar. Pero estos paneles de inteligencia y el ecosistema que los rodea reflejan un nuevo rol que la IA está desempeñando en tiempos de guerra: intermediar información, a menudo para peor.

Hay una confluencia de factores en juego. Las herramientas de programación asistida por IA permiten que la gente ya no necesite grandes habilidades técnicas para ensamblar inteligencia de código abierto, y los chatbots pueden ofrecer análisis rápidos —aunque dudosos— de dicha información. El aumento de contenido falso deja a los observadores del conflicto deseando un tipo de análisis crudo y preciso normalmente accesible solo a las agencias de inteligencia. La demanda de estos paneles también está impulsada por mercados de predicción en tiempo real que prometen recompensas financieras a cualquiera lo suficientemente informado. Y el hecho de que el Ejército estadounidense esté utilizando Claude de Anthropic en el conflicto (a pesar de haber sido calificada como riesgo en la cadena de suministro) ha puesto sobre la pista a estos observadores de que la IA es la herramienta de inteligencia que usan los profesionales. En conjunto, estas tendencias están creando una nueva especie de circo bélico habilitado por IA, que puede distorsionar el flujo de información tanto como aclararlo.

Como periodista, creo que este tipo de herramientas de inteligencia tienen mucho potencial. Aunque muchos sabemos que existen datos en tiempo real sobre rutas marítimas o cortes de energía, ver todo ese material reunido en un solo lugar es muy poderoso (aunque usarlo para ver cómo se desarrolla una guerra mientras comes palomitas y haces apuestas convierte el conflicto en un entretenimiento perverso). Pero hay motivos reales para pensar que este tipo de flujos de datos en bruto no son tan informativos como parecen.

Craig Silverman, experto en investigaciones digitales que enseña técnicas de investigación, ha estado llevando un registro de estos paneles (ya va por 20). «La preocupación es que se genera la ilusión de estar al tanto de todo y de tener el control, cuando en realidad lo único que haces es absorber un montón de señales sin entender necesariamente lo que estás viendo o sin poder extraer conclusiones verdaderas», explica.

Un problema tiene que ver con la calidad de la información. Muchos paneles incluyen «feeds de inteligencia» con resúmenes generados por IA de noticias complejas y cambiantes. Esto puede introducir inexactitudes. Por diseño, los datos no están especialmente curados. En cambio, los paneles muestran todo a la vez, con un mapa de lugares atacados en Irán junto al precio de criptomonedas poco conocidas.

Las agencias de inteligencia, por el contrario, combinan flujos de datos con personas que pueden aportar experiencia y contexto histórico. Además, por supuesto, tienen acceso a información privilegiada que no aparece en la web abierta.

La promesa implícita de quienes construyen y venden este tipo de canales de información sobre el conflicto en Irán es que la IA puede ser una gran fuerza democratizadora. Existe un flujo secreto de información al que solo han tenido acceso las élites, según esta lógica, pero ahora la IA puede llevarlo a todo el mundo para que lo use como quiera, ya sea para estar más informado o para hacer apuestas sobre ataques nucleares. Pero una abundancia de información —algo que la IA es indudablemente buena generando— no viene acompañada de la precisión o el contexto necesarios para una comprensión real. Las agencias de inteligencia hacen este trabajo internamente; el buen periodismo hace ese trabajo para todos los demás.

Por cierto, es difícil exagerar la relación de todo esto con los mercados de apuestas. El panel creado por el dúo de Andreessen Horowitz tiene una lista de apuestas realizadas en la plataforma de predicción Kalshi (en la que Andreessen Horowitz ha invertido). Otros paneles enlazan con Polymarket, que ofrece apuestas sobre si Estados Unidos atacará Irak o cuándo volverá internet a Irán.

La IA también lleva tiempo abaratando y facilitando la difusión de contenido falso, y ese problema está completamente a la vista durante el conflicto iraní: la semana pasada, el Financial Times encontró una avalancha de imágenes por satélite generadas por IA circulando en línea.

«El surgimiento de imágenes satelitales manipuladas o directamente falsas es realmente preocupante», afirma Silverman. La persona promedio tiende a considerar este tipo de imágenes como muy fiables. La difusión de estos bulos podría erosionar la confianza en una de las piezas de evidencia más importantes para mostrar lo que realmente está ocurriendo en la guerra.

El resultado es un océano de contenido habilitado por IA —paneles, mercados de apuestas, fotos reales y falsas— que hace que esta guerra sea más difícil, y no más fácil, de comprender.