El prototipo emplea una técnica para enfocar los objetos que reduce los mareos típicos que se sufren al sumergirte en mundos virtuales

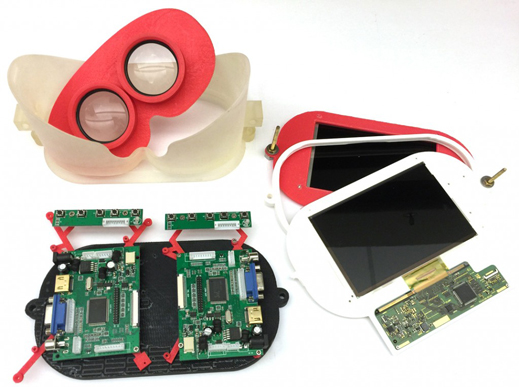

Foto: Un prototipo de un estereoscopio de campo de luz hecho por investigadores de la Universidad de Stanford en un esfuerzo por mejorar las señales de enfoque de la realidad virtual.

Estoy sentada en el laboratorio de Gordon Wetzstein en la Universidad de Stanford (EEUU), con un prototipo de un casco de realidad virtual (RV) sobre la cara, utilizando el mando inalámbrico de un Xbox para manipular una serie de modelos en 3D: un león, una tabla de ajedrez llena de piezas, una máquina de espresso, entre otros.

Las imágenes son bastante sencillas, modelos corrientes – del tipo que se podría bajar cualquiera de internet. Lo que sí es interesante sin embargo es lo que sucede mientras observo los modelos, haciéndolos girar con el mando: puedo enfocar distintas partes de las imágenes con profundidades distintas de la misma manera que haría al observar algo en la vida real. Así, cuando miro, por ejemplo, las piezas más cercanas, las que aparecen al fondo se ven borrosas, y viceversa cuando poso la mirada en las piezas del fondo. Y no siento náuseas ni mareos como sucede a veces al jugar con la RV, especialmente al fijar la vista en objetos que están cerca de mi cara.

La realidad virtual está al borde de la disponibilidad comercial, con cascos dirigidos a los consumidores como Oculus Rift, que se prepara para lanzarse al mercado el próximo año (ver El casco de realidad virtual Oculus incorporará mandos para manipular objetos). Pero mientras que la tecnología ha mejorado tremendamente durante los últimos años, aún quedan bastantes retos cruciales por afrontar – entre ellos esa sensación de mareo por movimiento que sufren algunas personas, como yo, cuando prueban la realidad virtual, lo que surge de algo que se conoce como el conflicto de vergencia-adaptación (en inglés: vergence-accommodation conflict).

Este conflicto es lo que Wetzstein, un profesor adjunto de ingeniería eléctrica, y otros investigadores de la Universidad de Stanford intentan resolver con el casco que probé, al que llaman estereoscopio de campo de luz – en esencia, un dispositivo que emplea dos LED para mostrar a cada ojo un "campo de luz" que hace que las imágenes virtuales parezcan más naturales.

Foto: Ejemplos de imágenes que demuestran el aspecto que se consigue mediante el uso del estereoscopio de campo de luz para enfocar determinadas partes que aparecen a profundidades distintas dentro de una escena en 3D.

Cuando miras algo en la vida real – una flor, por ejemplo – tus ojos se mueven y la lente de cada ojo se ajusta para enfocar lo que tienes delante. Con el 3D estereoscópico, una tecnología utilizada frecuentemente por empresas que fabrican cascos de realidad virtual, la cosa se complica. En este caso, se presenta una imagen ligeramente distinta a cada ojo; tu cerebro combina estas imágenes para lograr la sensación de profundidad. Pero puesto que estás mirando una pantalla plana e iluminada a cierta distancia y enfocando las imágenes en 3D que aparentan estar justo delante de ti, puede causar náuseas y mareos. Si no mejora esta tecnología, podría dificultar que algunas personas realmente interactúen de cerca con la realidad virtual, se trate de protagonizar un juego de disparos o de controlar un robot quirúrgico virtual.

"Cuando quieres tocar objetos virtuales, cosas que están cerca, y quieres interactuar con ellos, esto cobra mucha importancia", dice Wetzstein.

Con la esperanza de convertir la experiencia de la realidad virtual estereoscópica en algo más parecido a lo que se observa en la vida real, los investigadores de la Universidad de Stanford han construido un casco que contiene dos pantallas LCD, colocadas una delante de la otra con una luz de fondo detrás, un separador entre medias, y lentes delante. Se conecta a un ordenador que ejecuta el software necesario para que el sistema funcione.

El ordenador empieza con un modelo 3D, que el software de los investigadores convierte para cada ojo en un campo de luz – en este caso, según Wetzstein, es una tabla de cinco pulgadas por cinco pulgadas (lo que equivale unos 12,7 centímetros) de imágenes en 2D ligeramente distintas entre sí, dando así un total de 25 imágenes para cada ojo. Un algoritmo utiliza los campos de luz para generar dos imágenes para cada ojo, y en cada ojo se muestra una de estas imágenes en la pantalla LCD del fondo y la otra en la LCD de delante. Las imágenes entran por la pupila y se proyectan sobre la retina.

Lo que ves, dice Wetzstein, es una aproximación del campo de luz que se genera ópticamente por el que los ojos se pueden desplazar, enfocando lo que quieras del espacio virtual.

"Normalmente esto no es posible", dice.

Wetzstein dice que la tecnología incorporada al casco no es cara y no requiere del rastreo ocular para averiguar dónde el usuario ha posado su mirada, y espera que pueda incorporarse a los cascos que se comercialicen dentro de algunos años. Un artículo sobre este trabajo se presentará en agosto en la conferencia Siggraph de gráficas e interactuación computacionales en Los Ángeles (EEUU).

Marty Banks, un profesor de optometría y ciencias visuales de la Universidad de California en Berkeley (EEUU), también está investigando cómo resolver el problema de conseguir señales de enfoque correctas dentro de la realidad virtual – fue el coautor de un artículo que se presentará en Siggraph también y que Banks afirma que muestra imágenes de mayor resolución pero que sí depende del rastreo ocular. Banks dice que la pantalla en la que trabajan Wetzstein y otros es genial e inteligente, pero señala que la resolución sigue siendo relativamente baja (el artículo del grupo de la Universidad de Stanford indica que las escenas representadas tenían una resolución de 640 por 800 píxeles).

"Esto es algo principal a resolver: cómo aumentar la resolución. Y va a requerir más computación y más píxeles y más gasto", dice. "Queda aún bastante camino".