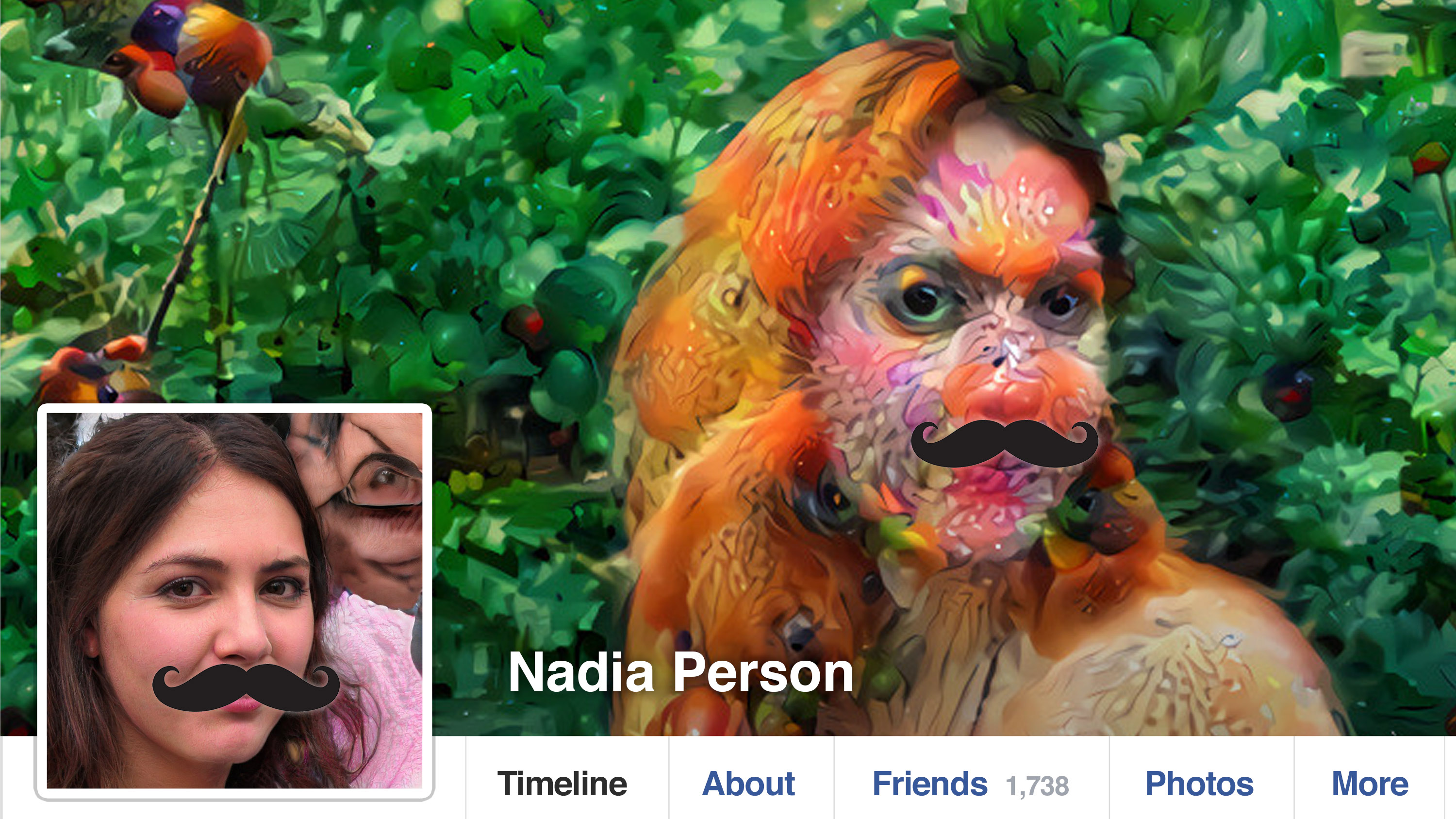

La red social presume de mantener estos perfiles en alrededor del 5 % del total, pero dado su volumen de usuarios, la cifra sigue siendo elevadísima. Aun así, ha detallado cómo funciona su Clasificación Profunda de Entidades, habilitado por inteligencia artificial, para que otros puedan replicarlo

En 2019, Facebook eliminó una media de unas 2.000 millones de cuentas falsas cada trimestre. Los estafadores usan estas cuentas falsas para difundir spam, enlaces de phishing o malware. Se trata de un negocio lucrativo que puede resultar devastador para cualquier usuario inocente. Para lograr este alto nivel de detecciones de cuentas falsas, Facebook utilizó un sistema de aprendizaje automático.

Para usarlo, el gigante tecnológico primero hizo una distinción de los dos tipos de cuentas falsas. Primero, "cuentas clasificadas erróneamente por el usuario", se trata de perfiles personales para negocios o mascotas con creados la intención de ser Páginas. Estas resultan relativamente fáciles de manejar ya que simplemente hay que cambiarlas de una categoría a la otra. Por otro lado, "las cuentas infractoras", son más serias. Se trata de perfiles personales que se dedican a estafas y a spam o que infringen los términos de servicios de la plataforma. Las cuentas infractoras se deben eliminar lo más rápido posible para que no generen una red demasiado amplia y que no enganchen otras cuentas reales.

Para llevarlo a cabo, Facebook usó tanto reglas codificadas a mano como aprendizaje automático para bloquear una cuenta falsa antes de su creación o antes de su activación. En otras palabras, antes de que pudiera perjudicar a usuarios reales.

Cuando la cuenta falsa ya ha sido activada, la detección se vuelve mucho más complicada, y ahí es donde entró en acción el innovador sistema de aprendizaje automático de la red social, conocido como Clasificación Profunda de Entidades (DEC por Deep Entity Classification).

Búsqueda en profundidad

DEC aprende a diferenciar a los usuarios falsos de los reales a través de sus patrones de conexión en la red. Se trata de "características profundas" e incluyen la media de edad o la distribución de género de los amigos del usuario. Facebook utiliza más de 20.000 características profundas para describir cada cuenta, creando una imagen de cómo se comporta cada perfil para dificultar que los atacantes venzan al sistema cambiando las tácticas.

El sistema comienza utilizando una gran cantidad de etiquetas menos precisas generadas por máquina a través de una combinación de reglas y otros modelos de aprendizaje automático que valoran si los usuarios son reales o falsos. Después de usar esos datos para entrenar una red neuronal, el modelo se perfecciona con un pequeño grupo de datos etiquetados a mano de mayor precisión, generado por personas de todo el mundo que comprenden las normas culturales locales.

El sistema de clasificación final puede identificar uno de los cuatro tipos de perfiles falsos: cuentas ilegítimas que no representan a una persona, cuentas comprometidas de usuarios reales que han sido robadas por atacantes, spammers que envían repetidamente mensajes que generan ingresos y estafadores que manipulan a los usuarios a divulgar su información personal. Desde la implementación de DEC, según Facebook, el volumen de cuentas falsas en la plataforma se ha mantenido en alrededor del 5 % de los usuarios activos mensuales.

Los detalles de los esfuerzos de limpieza de Facebook surgieron en medio de las preocupaciones sobre la manipulación de las elecciones presidenciales de Estados Unidos de 2020, especialmente en torno a los deepfakes. En diciembre de 2019, The New York Times informó de una campaña coordinada de desinformación que utilizaba deepfakes para crear muchas cuentas falsas con convincentes imágenes de perfil.

Proteger la democracia

El equipo de Facebook aseguró que el momento de esta iniciativa fue solo una coincidencia. "Se trata de detectar infracciones en general; no está específicamente dirigido a ningún tipo de tema electoral", afirmó el gerente de ingeniería del equipo de Integridad de la Comunidad de Facebook, Daniel Bernhardt. Pero DEC sirvió de complemento a los otros esfuerzos de la plataforma para evitar la manipulación de las elecciones. Como el sistema se basa en características profundas para clasificar cada perfil, será resistente a ser engañado por imágenes de perfil creadas por deepfakes, por ejemplo.

El fundador del Proyecto de Tecnología Reflexiva sin ánimo de lucro que estudia el diseño y la gestión de las plataformas, Aviv Ovadya, asegura que el esfuerzo de Facebook para ser más transparente con sus procedimientos de limpieza es encomiable. "Puede ser realmente útil y poderoso hablar detalladamente sobre las decisiones de construcción y las formas en las que funcionan los sistemas de seguridad que otras empresas podrían reproducir. Debido a que las compañías como Facebook tienen muchos más recursos para invertir que las empresas más pequeñas, es útil compartir este conocimiento".

Pero los esfuerzos de limpieza también tienen un largo camino por recorrer. Con 2.500 millones de usuarios activos al mes, el 5 % sigue equivaliendo a 125 millones de cuentas falsas. Y el aprendizaje automático solo ayudará hasta cierto punto: no importa con cuántos datos se entrene un modelo, nunca detectará todas las cuentas malas con una precisión perfecta. La plataforma probablemente tendrá que recurrir a otras combinaciones de humanos y máquinas para mejorar eso.